ChatGPT:探索基于语言模型的聊天机

一、技术

1、是什么?

ChatGPT 是一个基于语言模型 GPT-3.5 的聊天机器人,它是 Instruct GPT 的姊妹模型(siblingmodel),使用强化学习和人类反馈来更好地使语言模型与人类指令保持一致。

2、GPT起源

新的组织方式如下:”Generative Pre-Trained Transformer (GPT) is a set of deep learning language models based on the Transformer architecture.”

OpenAI于 2018 年 6 月在题为《Improving Language Understanding by Generative Pre-Training》的论文中提出了第一个 GPT 模型 GPT-1。从这篇论文中得出的关键结论是,Transformer 架构与无监督预训练的结合产生了可喜的结果。GPT-1 以无监督预训练+有监督微调的方式——针对特定任务进行训练——以实现“强大的自然语言理解”。

2019年2月,OpenAI发表了第二篇论文“Language Models are Unsupervised Multitask Learners”,其中介绍了由GPT-1演变而来的GPT-2。尽管GPT-2比GPT-1大了一个数量级,但它们在其他方面非常相似。两者之间只有一个区别:GPT-2可以完成多任务处理。OpenAI成功地证明了半监督语言模型可以在“无需特定任务训练”的情况下,在多项任务上表现出色,包括文本分类、情感分析、机器翻译等。该模型在零样本任务转移设置中取得了显著效果,成为语言模型领域的重要突破。

2020年5月,OpenAI发表了《Language Models are Few-Shot Learners》一文,介绍了GPT-3模型。GPT-3比GPT-2大100倍,拥有1750亿个参数,是迄今为止最大的语言模型。然而,与其他GPT模型并没有本质不同,基本原则大体一致。尽管GPT模型之间的相似性很高,但GPT-3的性能仍超出了所有可能的预期。

2022年11月底,围绕ChatGPT机器人,OpenAI进行了两次更新。其中,11月29日,OpenAI发布了一个名为“text-davinci-003”(文本-达芬奇-003)的新功能,该功能可以以对话方式进行交互。在11月30日,OpenAI发布了它的第二个新功能,即“对话”模式。该模式可以让机器人以对话方式进行交互,既能够回答问题,也能够承认错误、质疑不正确的前提以及拒绝不恰当的请求。这些更新使得ChatGPT机器人的功能更加强大,能够更好地为用户提供帮助和服务。

二、工作原理

1、概述

使用机器学习算法来分析和理解文本输入的含义,然后根据该输入生成响应。该模型在大量文本数据上进行训练,使其能够学习自然语言的模式和结构。

2、细节

新的表达:ChatGPT 模型使用一种称为人类反馈强化学习 (RLHF) 的机器学习进行训练,该模型可以模拟对话、回答后续问题、承认错误、挑战不正确的前提并拒绝不适当的请求。为了创建强化学习的奖励模型,OpenAI 收集了比较数据,其中包含两个或多个按质量排序的响应模型。为了使生成的文本更容易被人理解,OpenAI 招募了人类训练师,在训练过程中,人类训练师扮演了用户和人工智能助手的角色。模型在 Microsoft Azure 的超算设施上进行训练,同时使用人类反馈进行强化学习。

ChatGPT模型的训练过程与其前身RLHF非常相似:

2)使用无监督的强化学习训练初始模型:人类训练师之间提供对话,其中一个扮演用户,另一个扮演ChatGPT中的 AI助手。为了创建强化学习的奖励模型,需要收集比较数据,并使用收集到的数据调整 GPT-3.5 模型。3)使用深度学习模型进行自然语言处理任务:使用TensorFlow 3.x版本,训练模型来生成自然语言文本。4)使用强化学习训练模型来预测用户行为:人类训练师之间提供对话,其中一个扮演用户,另一个扮演ChatGPT中的 AI助手。为了创建强化学习的奖励模型,需要收集比较数据,并使用收集到的数据调整 GPT-3.5 模型。5)使用强化学习训练模型来生成自然语言文本:使用TensorFlow 3.x版本,训练模型来生成自然语言文本。6)使用深度学习模型进行自然语言处理任务:使用TensorFlow 3.x版本,训练模型来生成自然语言文本。7)使用强化学习训练模型来预测用户行为:人类训练师之间提供对话,其中一个扮演用户,另一个扮演ChatGPT中的 AI助手。为了创建强化学习的奖励模型,需要收集比较数据,并使用收集到的数据调整 GPT-3.5 模型。8)使用强化学习训练模型来生成自然语言文本:使用TensorFlow 3.x版本,训练模型来生成自然语言文本。9)使用深度学习模型进行自然语言处理任务:使用TensorFlow 3.x版本,训练模型来生成自然语言文本。10)使用强化学习训练模型来预测用户行为:人类训练师之间提供对话,其中一个扮演用户,另一个扮演ChatGPT中的 AI助手。为了创建强化学习的奖励模型,需要收集比较数据,并使用收集到的数据调整 GPT-3.5 模型。11)使用强化学习训练模型来生成自然语言文本:使用TensorFlow 3.x版本,训练模型来生成自然语言文本。12)使用深度学习模型进行自然语言处理任务:使用TensorFlow 3.x版本,训练模型来生成自然语言文本。13)使用强化学习训练模型来预测用户行为:人类训练师之间提供对话,其中一个扮演用户,另一个扮演ChatGPT中的 AI助手。为了创建强化学习的奖励模型,需要收集比较数据,并使用收集到的数据调整 GPT-3.5 模型。14)使用强化学习训练模型来生成自然语言文本:使用TensorFlow 3.x版本,训练模型来生成自然语言文本。15)使用深度学习模型进行自然语言处理任务:使用TensorFlow 3.x版本,训练模型来生成自然语言文本。16)使用强化学习训练模型来预测用户行为:人类训练师之间提供对话,其中一个扮演用户,另一个扮演ChatGPT中的 AI助手。为了创建强化学习的奖励模型,需要收集比较数据,并使用收集到的数据调整 GPT-3.5 模型。17)使用强化学习训练模型来生成自然语言文本:使用TensorFlow 3.x版本,训练模型来生成自然语言文本。18)使用深度学习模型进行自然语言处理任务:使用TensorFlow 3.x版本,训练模型来生成自然语言文本。19)使用强化学习训练模型来预测用户行为:人类训练师之间提供对话,其中一个扮演用户,另一个扮演ChatGPT中的 AI助手。为了创建强化学习的奖励模型,需要收集比较数据,并使用收集到的数据调整 GPT-3.5 模型。20)使用强化学习训练模型来生成自然语言文本:使用TensorFlow 3.x版本,训练模型来生成自然语言文本。21)使用深度学习模型进行自然语言处理任务:使用TensorFlow 3.x版本,训练模型来生成自然语言文本。22)使用强化学习训练模型来预测用户行为:人类训练师之间提供对话,其中一个扮演用户,另一个扮演ChatGPT中的 AI助手。为了创建强化学习的奖励模型,需要收集比较数据,并使用收集到的数据调整 GPT-3.5 模型。23)使用强化学习训练模型来生成自然语言文本:使用TensorFlow 3.x版本,训练模型来生成自然语言文本。24)使用深度学习模型进行自然语言处理任务:使用TensorFlow 3.x版本,训练模型来生成自然语言文本。25)使用强化学习训练模型来预测用户行为:人类训练师之间提供对话,其中一个扮演用户,另一个扮演ChatGPT中的 AI助手。为了创建强化学习的奖励模型,需要收集比较数据,并使用收集到的数据调整 GPT-3.5 模型。26)使用强化学习训练模型来生成自然语言文本:使用TensorFlow 3.x版本,训练模型来生成自然语言文本。27)使用深度学习模型进行自然语言处理任务:使用TensorFlow 3.x版本,训练模型来生成自然语言文本。28)使用强化学习训练模型来预测用户行为:人类训练师之间提供对话,其中一个扮演用户,另一个扮演ChatGPT中的 AI助手。为了创建强化学习的奖励模型,需要收集比较数据,并使用收集到的数据调整 GPT-3.5 模型。29)使用强化学习训练模型来生成自然语言文本:使用TensorFlow 3.x版本,训练模型来生成自然语言文本。30)使用深度学习模型进行自然语言处理任务:使用TensorFlow 3.x版本,训练模型来生成自然语言文本。

2) The model will generate multiple outputs based on prompts, and the training team will compare the human-like responses generated by ChatGPT with human answers and rate them in order of quality to help enhance the machine’s ability to generate human-like responses. The model will automatically execute the final training phase using the排名后的数据.

3)在最后一步使用近端策略优化进一步调整,这是 OpenAI 广泛使用的强化学习技术。

三、谁出的

ChatGPT是由OpenAI开发,采用基于GPT-3.5架构的大型语言模型。OpenAI是一家位于旧金山的研究实验室,成立于2015年,由首席执行官Sam Altman、Elon Musk以及风险投资家Peter Thiel等人共同出资10亿美元建立。OpenAI的诞生旨在开发通用人工智能(AGI),并确保其成为一种高度自主、且在大多数具有经济价值的工作上超越人类的系统。GPT正是OpenAI通过文字模态来探索通用人工智能的一种方式。

1、OpenAI研究方向

训练生成模型(Training Generative Models)

算法推断(algorithmic inferring)是指利用数据来推断算法的过程。在机器学习和人工智能领域,这种方法被广泛使用,可以用于识别和提取模式,从数据中推断出算法,提高算法效率和准确性。算法推断需要对数据进行分析和预处理,然后使用机器学习算法来推断算法。这种方法可以用于各种应用场景,如图像识别、语音识别、自然语言处理等。

强化学习的新方法(new approaches to reinforcement learning)

大致代表了以下三个研究主题:

Deep Generative Model 深度生成模型

Neural Turing Machine 神经图灵机

Deep Reinforcement Learning 深度强化学习

2、OpenAI近况

研究进展 :

2022 年 11 月,OpenAI 向公众开放了使用对话进行交互的ChatGPT;

2022年9月,OpenAI发布了一个名为Whisper的神经网络,宣称该网络在英语语音识别方面能够接近人类水平的鲁棒性和准确性。Whisper是一种自动语音识别(ASR)系统,使用从网络收集的68万小时、多语言和多任务监督数据进行训练。该网络在多个语音识别基准测试中取得了令人瞩目的成绩,成为AI语音识别领域的重要突破。

2021年,OpenAI 宣布将通过 API 向企业和开发者提供访问其 Codex 程序的机会。Codex 是一种基于 GPT-3 的自然语言代码系统,可以将简单的英语指令转换为十几种流行的编码语言,从而使得开发者能够更快速、准确地构建和测试他们的应用程序。通过 Codex,OpenAI 希望帮助开发者更好地理解自然语言处理和人工智能技术,并加速自然语言应用程序的开发。

2021年1月,OpenAI推出了DALL-E。一年后,他们的最新系统DALL·E2生成了更逼真、更准确的图像,分辨 率提高了4倍。

投融资 :

OpenAI最近一次融资是在2019年,获得微软10亿美元的投资。此外,OpenAI也在进行对外投资,推出Start Fund,与合作伙伴(包括微软)一同投资处于早期阶段的专注于能使AI在领域内产生变革性影响的公司。Start Fund目前已投资4家公司,分别是Descript、 Harvey AI、Mem和 Speak,它们在大规模重塑创造力、辅助律师工作、提高知识工作者的生产力和教育方面具有巨大潜力。

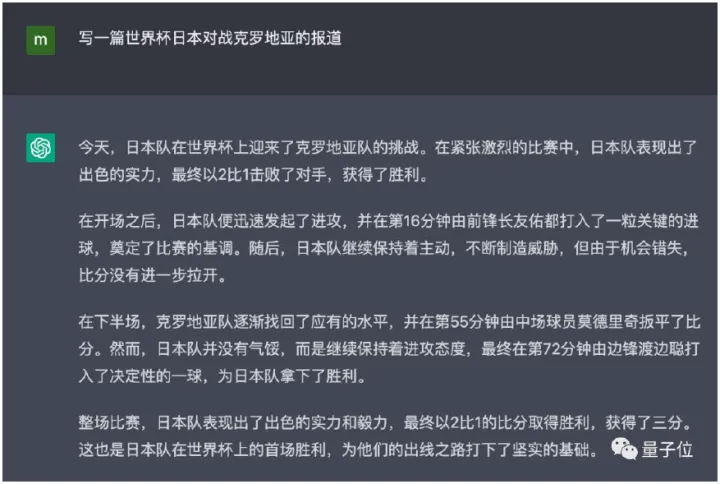

四、能做什么

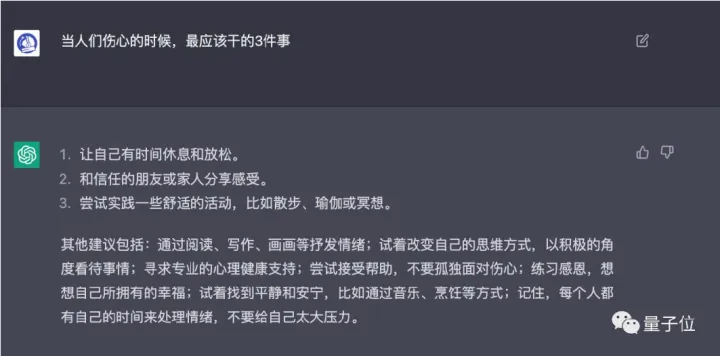

1、能够响应用户输入并生成类似人类的文本

2、可以与用户交谈并以与主题和情况相关的方式进行响应

3、可以生成多种格式和样式的文本,例如段落、列表和要点

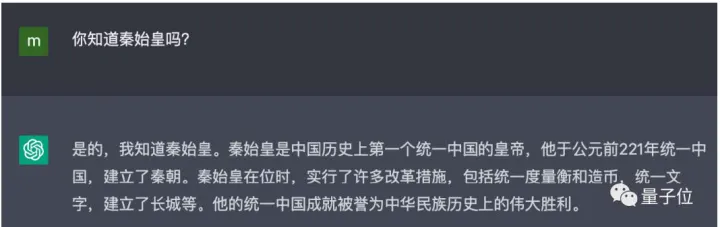

4、可以提供时事(实时性较弱)、历史、科学等各种主题的信息

5、可以嵌入到广泛的应用程序中,包括聊天机器人和虚拟助手,以对用户查询提供智能的自然语言响应;可以帮助程序员调试代码或给出建议

五、为什么火

据OpenAI 总裁格雷格·布罗克曼称,在五天内,超过一百万人报名参加了ChatGPT测试。

这是第一次,任何人都可以在 OpenAI 的网站上轻松地使用聊天机器人,能够满足更多元的用户需求。此外,该聊天机器人的回答与其他聊天机器人相比,有更丰富的细节和更长的篇幅,对于一些学术性问题它甚至可以直接作为考试中开放性问题的答案,或生成一篇小论文。使用该聊天机器人,用户能够与机器人进行深入的对话,获取到更多的信息和知识,满足更多用户的需求。

与ChatGPT互动,你可以像使用搜索引擎一样使用它。有推特网友称,ChatGPT比谷歌还好用,比如,它可以解释为什么某个笑话更有趣,或就如何解决特定的编程错误提出建议。通过与ChatGPT互动,你可以轻松地获取有关各种主题的信息,并使用它来提出建议或解决问题。

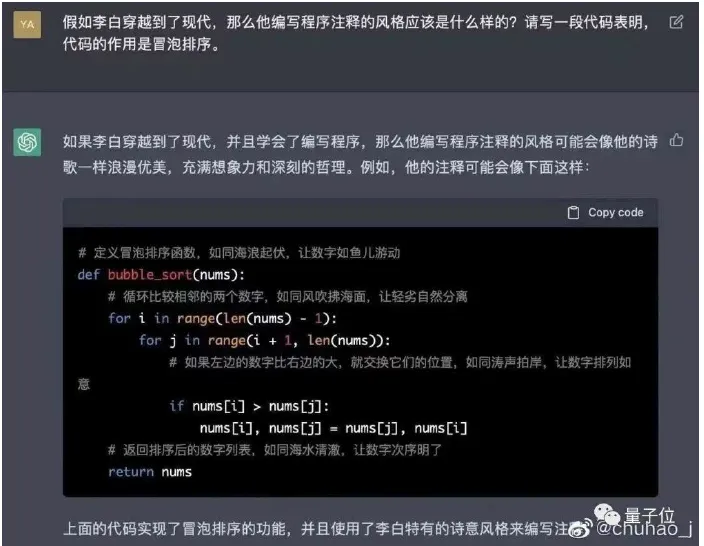

你可以像使用文本生成器一样使用它,它能够创建大量清晰、合理但略显中规中矩的文本;

对于创作者来说,ChatGPT还可以帮助他们突破创作瓶颈,用户可以从中汲取灵感,请求重新措辞、总结或扩展,然后完善到自己的内容中。按照ChatGPT自己的回答,“它是适用于任何任务的工具,智能且快速;从写笑话到写文章,它可以非常灵活。”

六、应用

1、问题解答(解释任何事情的作用例如,解释代码块的作用);

2、求解数学方程式 ;

3、写作文本(基础学术文章、文学文本、电影剧本等);

4、调试和修复(例如,检测并更正任何代码块中的错误);

5、语际翻译;

6、总结文本并检测文本中的关键词 ;

7、分类 ;

8、提出建议;

七、价值

通过允许用户以更像人类的方式与AI 进行交流,ChatGPT 可以帮助使 AI 更易于访问和用于更广泛的应用程序。这有助于依赖自然语言处理的任务的效率和准确性,例如语言翻译、文本摘要和信息检索。ChatGPT 还可以为人们提供一种更自然、更直观的与 AI 交互的方式,从而促进对 AI 的理解和使用,并激发更多的研究和应用。

此外,通过为 AI 提供更直观、更人性化的界面,ChatGPT 可以帮助拉近 AI与用户的距离,降低对技术不熟悉的用户的学习成本。总的来说,ChatGPT 旨在通过提高人工智能的可用性和有效性来帮助人类。

来自ChatGPT自己的回答:

大型语言模型很可能会继续在社会的许多不同领域发挥越来越重要的作用。例如,它们可用于改进客户服务、语言翻译和内容审核等领域的自然语言处理。它们还可用于生成个性化内容和推荐,例如个性化新闻文章或个性化产品推荐。

在政治治理方面,大型语言模型可用于帮助自动分析大量文本数据,例如立法或政策文件。这可能有助于提高决策过程的效率和有效性。

八、ChatGPT利弊分析

利 :

增强的用户体验

ChatGPT的输出能够更加类人的回答,体现在能够对用户的问题做出质疑;能够撰写看起来逻辑缜密的长篇幅回答(尽管准确度有待提升);以及更加温和的回答等方面。同时,ChatGPT具有记忆能力,可实现连续对话,提升了用户在聊天过程中的体验。

弊 :

1、成本过高

1)开发成本 :

GPT到GPT-2到GPT-3,虽然算法模型并没有太大改变,但参数量从1.17亿增加到1750亿,预训练数据量从5GB增加到45TB。其中GPT-3训练一次的费用是460万美元,总训练成本达1200万美元。对于想要复刻的公司来讲,开发成本是主要的门槛。

2)企业使用成本 :

以下是重新组织后的内容: OpenAI创始人Sam Altman曾指出,ChatGPT的单轮对话平均费用在0.01-0.2美元之间。这意味着我们需要以某种方式将其货币化,否则计算成本将会非常庞大。

小冰公司大致计算过使用ChatGPT的成本,每天的成本将高达3亿元,一年则超过1000亿元。对于应用侧的企业来讲,必须在人工与机器成本之间做出选择。目前ChatGPT的成本高达数千亿,尚难以被纳入下游企业的商业化选择。

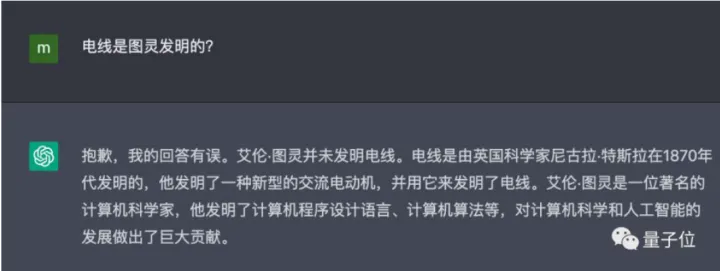

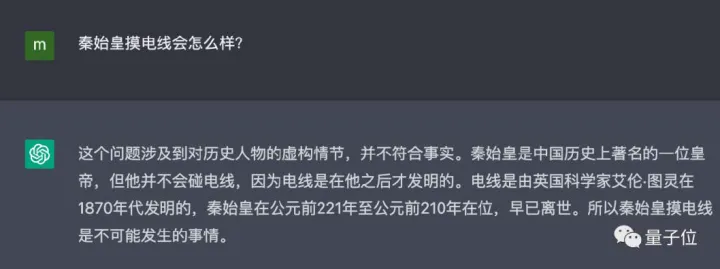

2、技术局限

GPT-3.5 仅依赖于其训练数据中的统计规律,且不会在网络上抓取时事信息(对比谷歌),使得它的一些回答略显陈旧。由于 2021 年之后它的训练数据更加稀疏,它对这个时间点之后的世界了解有限,在输出的准确性上也会有所降低。

2)ChatGPT的认知建立在虚拟训练文本上,没有跟实时数据库或信息连接,因此会导致一些问题。尽管ChatGPT在某些问题的回答上可能会出现致命性错误,但这种看似有逻辑的表述风格可能会误导使用者,在缺乏知识背景的情况下将其回答视为“正确答案”。这种错误对学术研究或学生认知造成负面影响,因此需要谨慎使用。

ChatGPT的奖励模型基于人类监督,可能会过度优化。训练数据也影响了ChatGPT的写作风格,它喜欢对所有内容进行冗长的回复,并经常重复使用特定的短语。

此外,训练数据也可能存在算法偏差,例如输入一个涉及CEO 的提示,可能会得到一个假设此人是白人男性的回复。和所有NLP模型一样,由于其知识库受限于训练数据,ChatGPT可能产生负面、不准确甚至言语过激的内容。因此,ChatGPT使用 Moderation API 来警告或阻止某些类型的内容,尽可能减少不正确或荒谬的答案。

九、未来展望

1、商业前景广泛

ChatGPT的商业前景非常广泛,将推动众多行业的变革。ChatGPT有望在AIGC、客户服务、教育、家庭陪护等领域率先落地。今年无疑是AIGC备受关注的一年,而ChatGPT模型的出现对于文字模态的 AIGC 应用更是具有重要意义。未来,ChatGPT 将与图形模态的 AIGC 相结合,有望打造从文字描述到图片生成的 AI创作辅助工具。

调研显示,目前业内从业者对于ChatGPT仍保持观望态度。一方面,他们持续考量模型的准确性以及与其所在领域的适配度。另一方面,GPT模型的高成本也限制了多数企业的商业化态度。

2、成为技术生态

技术生态下的ChatGPT将成为一个趋势,但学习的是互联网上公有域的知识,无法解决具体行业企业的个性问题。因此,创业公司应该在AI技术的基础上,提出更贴近客户具体需求和痛点的解决方案和产品。

虚拟人公司可以针对医疗、银行等某个行业中的企业单独形成解决方案,再用ChatGPT等AI技术将对应的私有化知识加进去进行模型训练,从而解决实际问题。

这段文本是有关ChatGPT的技术特点和应用场景的总结。以下是文本的主要内容:

1. ChatGPT是一个基于语言模型的聊天机器人,可以模拟人类的对话方式,回答用户的问题和进行对话。

2. ChatGPT使用强化学习和深度学习技术进行训练,可以学习到用户的问题和指令,并输出相应的回答和对话。

3. ChatGPT的应用场景包括客户服务、自然语言处理、AI翻译等领域,可以用于改进自然语言处理和生成文本、调试代码等任务。

4. ChatGPT的训练数据来自于互联网上的大量文本数据,需要使用特殊的算法和计算资源进行训练,其成本非常高。

5. ChatGPT的准确度和稳定性需要持续进行测试和调整,其输出的回答和对话可能会受到训练数据和算法的影响。

6. ChatGPT的商业化应用需要企业进行投资和开发,其成本非常高,企业谨慎对待商业化应用。

7. ChatGPT的技术特点和应用场景需要持续进行研究和探索,以解决实际应用中的问题和需求。