自2023年起,生成式人工智能如ChatGPT及其通用语言大模型已在学术界引发巨大波澜。仅需几个关键词,ChatGPT便能创作出看似专业的论文,这些AI生成的作品甚至能骗过资深编辑和学术专家的眼睛,成为期刊上正式发表的文章。一些学生利用ChatGPT编辑的论文交给老师后,也获得了高分评价。这一现象无疑引发了一个问题:ChatGPT等人工智能是否将导致充满知识的学术编辑,特别是人文学科专家的失业?

01 索卡尔事件及其学术影响

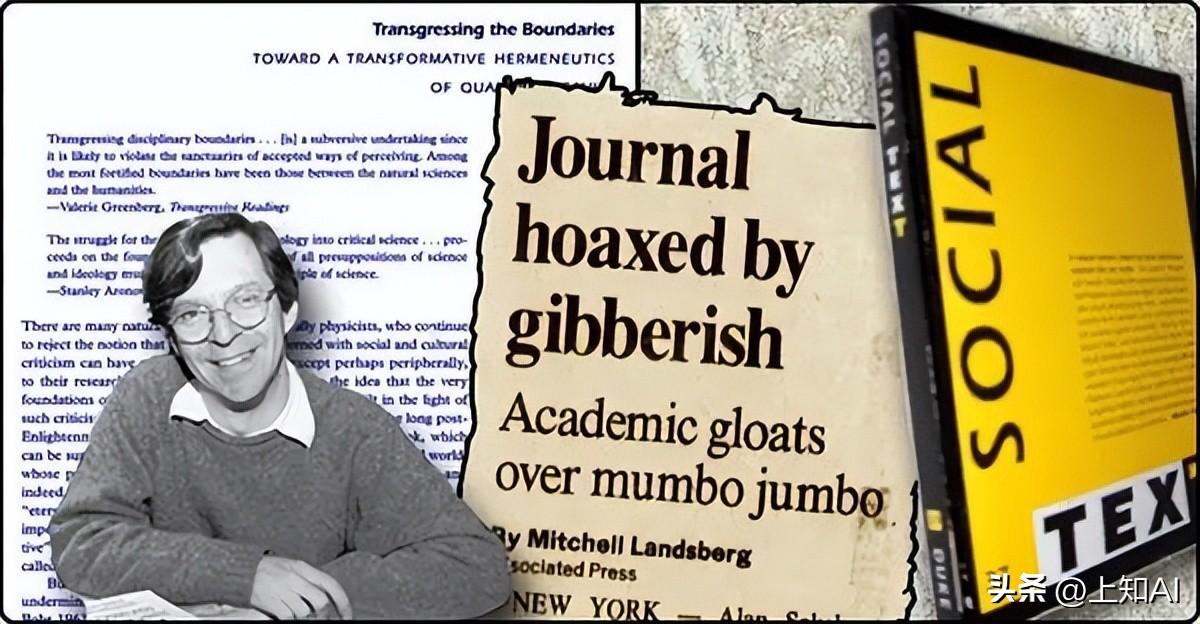

在探讨ChatGPT对学术编辑挑战之前,值得回顾的是学术史上的索卡尔事件。1996年5月18日,《纽约时报》头版报道了量子物理学家艾伦·索卡尔利用计算机创作了一篇混合使用“后现代词汇”的论文。这篇文章被《社会文本》杂志接受并发表,受到了包括杂志编辑阿诺罗维茨、约翰·布伦克曼和杜克大学的知名学者弗里德里克·詹姆逊在内的学术界的认可。然而几个月后,索卡尔在《纽约时报》揭露了这篇文章的真相,他解释说:

“我决定进行一个试验:一个以文化研究为重点的北美杂志——其编辑包括弗里德里克·詹姆逊和安德鲁·罗斯这样的学术大师——是否会发表一篇明显的胡说八道文章?这篇文章(a)听起来很不错,(b)符合编辑们的意识形态偏见。”

索卡尔的目的并非侮辱杂志或编辑,而是揭示所谓“后现代主义”作品在学者、编辑和读者中的“高级迷信”。索卡尔事件不只是一位物理学家和一本杂志的争议,更揭示了一个哲学社会科学的秘密:这些论文是真正讨论实际问题,还是只是按照特定格式和模板编造的麻醉人心的文章?

这场事件引发了广泛讨论,包括雅克·德里达、布鲁诺·拉图尔、理查德·罗蒂、布鲁斯·罗宾斯等知名学者参与。讨论的核心不再是反击索卡尔事件的嘲讽,而是从学术写作和编辑角度重新思考哲学社会科学的定位。

02 人工智能与哲学社会科学研究

索卡尔事件的透视下,我们可以思考ChatGPT对人文学术编辑的挑战。2023年,虽然西方后现代主义用词不再流行,中国学术界与之有所不同,但面对通用语言大模型和生成式AI的挑战,中国的哲学社会科学研究也面临类似的问题。

曾有物理学者在一个AI会议上问:“ChatGPT更容易模仿哪类文章,文科还是理工科?”得出的结论是,文科文章更易被ChatGPT模仿,因为理工科文章不仅有文本形式,还有大量实验数据和理论推导,这是ChatGPT无法模仿的。哲学社会科学文章如何呢?ChatGPT 4.0发布后,人们发现它不仅能写出形式完整、逻辑完美、辞藻华丽的论文,甚至能模仿名家风格。但哲学社会科学论文的实质内容仍需具备丰富学识的编辑,用深刻的学术阅历来甄别。

03 人工智能与中国哲学社会科学研究

中国特色哲学社会科学扎根于新时代中国特色社会主义实践,研究者和学术编辑需思考ChatGPT与中国特色哲学社会科学研究的辩证关系。

学术编辑应从形式导向走向问题导向。ChatGPT虽能辅助文章编辑,但无法参与中国实践。ChatGPT和人类的合作将提升编辑效率,形成密切协作模式。生成式AI与人工智能时代的合作,将为中国特色哲学社会科学的繁荣提供新动力。

点击这里开启→_→【上知AI】开启人工智能对话问答