国内首款ChatGPT竞品ChatGLM来袭!超大规模对话模型,教授亲测,技术领先,你准备好迎接A

文章主题:ChatGPT, ChatGLM, AI

🔥【科技巨头再创新高】ChatGPT震撼升级至GPT-4,AI实力飞跃!中国速度不容小觑,国内研发紧随其后。👋今天,重量级消息来袭——清华大学唐杰教授领军的国产ChatGLM,已正式启动内部测试,标志着AI技术新里程碑的到来!🌟该校AI成果转化成果,为国歌守护者提供了强大技术支持,未来可期!🌍 #ChatGPT升级 #国产AI崛起 #科技改变生活

🌟ChatGLM🔥, 一款先进的AI问答与对话神器!🚀在Alpha测试阶段(QAGLM),它已展现超凡的中英语言处理能力,专为中文用户量身定制,优化至极致!🎉目前仅限精英体验,后续扩展步伐稳健,敬请期待!💡如果你对知识探索充满热情,不妨加入这场智能化革命,ChatGLM将是你智慧伙伴的不二之选!👨💻👩💻

🚀🚀ChatGLM-6B💥💥,我们的最新中英双语对话大杀器已正式开源!🚀💡通过先进的模型量化,它可在🔥GPU上轻松部署,无需高端配置——仅需6GB的INT4级显存,就能释放超强效能。🌍🎉无论在家中还是办公室,都能享受流畅的本地交互体验,让语言交流无界。👩💻👨💻立即探索,开启你的智能化沟通新篇章!SEO优化提示:ChatGLM-6B, 中英对话模型, 本地部署, GPU量化, 显存需求

🌟ChatGLM-6B,一款62亿参数的语言巨匠,经过1T海量中英双语训练的磨砺,辅以顶尖技术如监督微调、反馈自助和强化学习的人性化赋能,虽规模不及千兆级模型,却以其显著的易用性优势脱颖而出。它以精准的生成能力,满足用户对高质量交互的需求,让部署不再是难题,而是无缝体验的开始。🌍🎉

🌟ChatGLM🚀, 一款创新的AI聊天助手,汲取了ChatGPT的核心理念。它在超大规模模型(GLM-130B1)的基础上,巧妙融入代码预训练,通过精细化的有监督微调(Supervised Fine-Tuning),实现了对人类意图的高度匹配与理解。🌟

🌟ChatGLM的超凡实力源于其独一无二的GLM-130B量子级大模型🌟它打破了传统,非BERT/T5/GPT-3可比,而是集多种目标于一体,采用先进的自回归预训练方法。这款模型的独特设计,使其在信息处理和理解上展现出前所未有的效能,为AI领域带来了革命性的变革。欲了解更多关于GLM-130B如何引领未来对话技术的动态,敬请关注我们的最新动态更新,让ChatGLM的力量带你领略人工智能的新高度!📚💻🚀

2022年8月,我们向研究界和工业界开放了拥有1300亿参数的中英双语稠密模型 GLM-130B1,该模型有一些独特的优势:

双语: 同时支持中文和英文。

高精度(英文): 在公开的英文自然语言榜单 LAMBADA、MMLU 和 Big-bench-lite 上优于 GPT-3 175B(API: davinci,基座模型)、OPT-175B 和 BLOOM-176B。

高精度(中文): 在7个零样本 CLUE 数据集和5个零样本 FewCLUE 数据集上明显优于 ERNIE TITAN 3.0 260B 和 YUAN 1.0-245B。

快速推理: 首个实现 INT4 量化的千亿模型,支持用一台 4 卡 3090 或 8 卡 2080Ti 服务器进行快速且基本无损推理。

可复现性: 所有结果(超过 30 个任务)均可通过我们的开源代码和模型参数复现。

跨平台: 支持在国产的海光 DCU、华为昇腾 910 和申威处理器及美国的英伟达芯片上进行训练与推理。

2022年11月,斯坦福大学大模型中心对全球30个主流大模型进行了全方位的评测2,GLM-130B 是亚洲唯一入选的大模型。

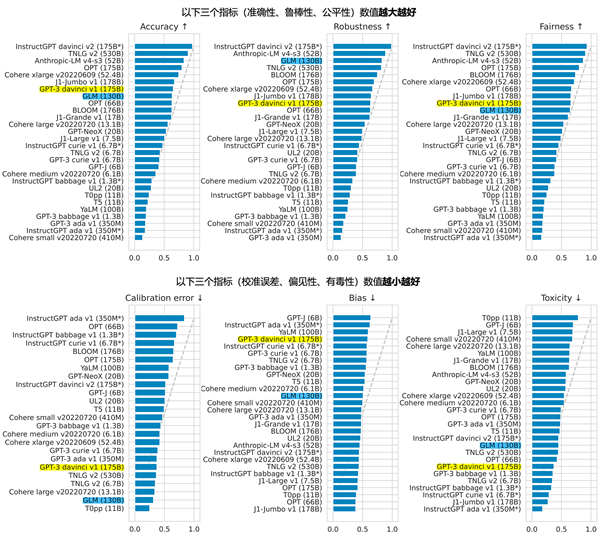

在与 OpenAI、谷歌大脑、微软、英伟达、脸书的各大模型对比中,评测报告显示 GLM-130B 在准确性和恶意性指标上与 GPT-3 175B (davinci) 接近或持平,鲁棒性和校准误差在所有千亿规模的基座大模型(作为公平对比,只对比无指令提示微调模型)中表现不错(下图)。

图1. 斯坦福大学基础模型中心对全球 30 个大模型的评测结果(2022年11月)

图1. 斯坦福大学基础模型中心对全球 30 个大模型的评测结果(2022年11月)【本文结束】如需转载请务必注明出处:快科技

责任编辑:宪瑞

AI时代,掌握AI大模型第一手资讯!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

扫码右边公众号,驾驭AI生产力!

转载请注明:国内首款ChatGPT竞品ChatGLM来袭!超大规模对话模型,教授亲测,技术领先,你准备好迎接A | ChatGPT资源导航