ChatGPT背后的隐私合规挑战:AI服务商的数据控制者身份解析

文章主题:ChatGPT, 数据控制者, AI合规

本期观点摘要:

🌟ChatGPT等AI技术巨头,以直接面向用户的形式存在,它们在处理和存储个人数据的过程中,扮演着数据控制者的角色,这需要我们关注其对个人信息的保护合规性。🛡️

🌟生成式AI服务商的独特之处在于,相较于移动互联网APP的常见操作,它们在个人信息处理活动中展现出了特有的模式和挑战。💡数据安全和合规性成为了他们重点关注的领域,每一步都需严谨对待。🎨在这个数字化时代,他们的运作方式往往更加个性化和智能化,用户信息的收集、使用和保护成了核心议题。🛡️隐私政策的制定与执行,以及如何在提供创新服务的同时遵守相关法规,是他们必须面对的现实考验。🔍不同于APP直接收集并处理大量用户数据,生成式AI服务商的数据处理过程可能更为复杂,涉及到模型训练、算法优化等技术环节,这就需要更高的透明度和合规标准。💡SEO优化提示:使用关键词如”个性化处理”、”AI安全”、”合规挑战”、”隐私保护”等,同时保持内容的连贯性和专业性。

🌟 GDPR权威指南💡:欧盟DPA不仅是数据守护者,更是合规辅导者🌍。他们不直接决定市场准入,而是专注于对企业进行严格的数据合规监督与教育。\n👀 企业的数据之路,从此不再迷茫,每一步都遵循着严谨的法规指引。\n记得,GDPR下,合规才是王道🏆!

4.未来真正的挑战来自于AI赋能的各类应用服务,解决新的数据安全问题需要新思维。

C端AI应用服务商是

数据控制者(data controller)

🌟了解了!作为一名文章写作专家,我将对原文进行优化处理,以适应SEO和提升可读性。🌟在数据合规的广袤领域中,并非所有参与者都自动承担义务。这需要根据技术基础、业务环境及法律法规的细致考量来明确界定。当角色与责任交织时,合规义务还需针对各不相同的业务流程进行精准匹配。💡上文深度探讨了大模型开发者,在其模型开发过程中可能并非法律意义上的数据控制者(data controller),这一关键点基于上述分析框架。🎯关键词优化:数据合规、义务主体、技术原理、业务场景、法律规范、大模型研发、隐私数据合规、法律主体、业务流程匹配。

🌟认知升级:个人生成式AI服务商的隐性隐私守护者🔍对于C端用户来说,那些通过生成式AI技术提供个性化服务的平台,实际上扮演着数据控制者的角色。就像ChatGPT在2022年11月迅速刷爆1亿里程碑,成为史上增长最快的消费者应用一样,OpenAI的数据处理能力与公众接受度的双重突破,无疑确立了其数据合规上的核心地位。🚀每一步用户互动,每一个生成内容,都是对隐私边界的一次微妙试探和管理。这些服务商不仅需要具备先进的技术实力,还需时刻坚守数据保护的承诺,以确保用户信息的安全与透明。🛡️SEO优化提示:面向个人用户的AI服务隐私合规、OpenAI增长速度、ChatGPT里程碑等关键词可适度融入,提升搜索引擎可见性。

🌟文章改写🌟在全球范围内,个人AI应用服务提供商已逐步建立起完善的数据合规机制,通过详尽的隐私协议和用户条款,确保透明度,让用户明确知晓各类数据的收集范围及处理方式。例如,OpenAI在其隐私政策中详细列出了数据类别,包括账户详情、通信内容以及使用行为记录等,旨在服务于提供优化服务、防止欺诈、保障网络安全、履行法定义务等多个目的。同样,面向大众的图片生成AI提供商Midjourney也以其简洁易懂的隐私策略赢得了用户的信赖。国内虽暂未有产品正式推出,但已有企业在其测试版本中悄悄加入了隐私政策元素,为未来的合规运营打下了基础。记得关注这些走在科技前沿的公司,他们的数据管理实践将引领行业风向。📚💻

这也就不难解释为什么数据保护机构DPA是第一批入场的监管机构。3月31日,意大利数据监管机构Garante宣布暂时禁止ChatGPT,并要求OpenAI 在20天内相关问题作出回应[3]。这是数据监管机构DPA对一项新兴应用的正常反映,但被误读为DPA可以对特定业务采取永久性措施。相反,根据欧盟GDPR,DPA虽然有天价处罚权,但其职权被严格限制在矫正性权力范围内,包括建议,警告以及暂时性的或者具有明确期限的禁令[4]。换言之,只要服务提供者满足数据合规要求,则DPA不得对其采取市场禁入措施。在其临时禁止令受到广泛批评后,4月12日,Garante释放信号:“如果 OpenAI 采取有效措施,我们准备在4 月30日重新开放 ChatGPT”[5]。

生成式AI服务商

数据合规的独特性

与移动互联网相比,面向个人的生成式AI应用在数据合规上有很多相似之处,包括制定隐私政策、业务协议,明确处理用户数据的合法性基础,通过隐私保护设计在信息系统中支持用户围绕其账户信息和使用服务过程中产生的个人信息的相关权利,包括查询、访问、更正、删除等。但一方面,我们更加关注其在个人信息处理活动中的独特性:

第一、收集的个人信息种类相对较少。导航软件、打车、购物等典型的移动APP为实现对用户个性化服务的闭环,需要实时收集用户较多类型的个人信息;而目前的生成式AI应用,以OpenAI和Midjourney为例,从其底层逻辑出发,其更加关注生成内容的质量,在应用服务阶段收集个人信息主要是建立用户账户体系,接受用户指令(prompt)并与之交互,因此收集的个人信息相对较少,包括账户信息(用户名、邮件)、使用记录(cookie等),如果涉及购买服务等交易,则还包括支付信息。因此,Midjourney更是以表格的形式,明确列出了不收集的用户信息种类:包括用户敏感信息,生物识别信息、地理位置信息等等。这些信息对于生成式AI应用确实也无关紧要。

第二、在更早阶段以及更广泛地采取个人信息去标识化以及匿名化措施。在提供服务过程中,生成式AI主要围绕用户账号体系及通信内容构建数据安全防护体系。以ChatGPT为例,尽管在模型训练阶段,其采集的数据源中的用户个人信息较少(且主要为公开信息),但在应用服务阶段,问答式的会话功能会产生较为敏感的通信内容,模型根据与用户通信内容(上下文环境)进一步分析并生成回复。为降低用户通信内容泄露后产生的风险,生成式AI会在更早阶段采取用户身份信息去标识化及匿名技术,或者将用户身份信息与通信内容相互分离,或者在模型生成回复内容后及时删除通信内容等安全类措施。这也是由生成式AI更关注反馈内容,而非用户行为的逻辑所决定,这与建立在用户行为特征基础上,以个性化推荐见长的移动APP有显著差异。

第三、由以上两方面影响,生成式AI与移动APP在数据安全的风险领域有所不同。移动互联网APP需要直接收集大量个人信息,用户数据库易成为黑客攻击和数据泄露的目标。然而,在生成式AI 应用中,虽然其直接收集的用户信息种类少,但其风险集中在模型被攻击从而反向溯源数据库,以及用户通信内容泄露的隐患。意大利数据监管机构对OpenAI发出暂时禁令,即是由于用户通信内容因出现服务bug而泄露的事故。为减轻风险,在技术上已经明显具备先发优势的OpenAI,开始探索支持用户可以选择将个人删除通信记录。4月23日,OpenAI 推出新控件,允许 ChatGPT 用户可以选择关闭其聊天历史记录,且可以不用于模型训练目的[6]。

第四、在输出阶段,如果用户引导的问题涉及个人信息时,基于大模型的语言预测生成的算法逻辑,输出结果中的个人信息有可能是编造的,虚假的,这可能违反了个人信息保护法上的信息质量原则,即保持个人信息准确性要求。但这类问题的背后实质是生成式AI在内容治理中面临的一般性问题,即AI进入“幻想”,编造不准确甚至是虚假的信息。

OpenAI在研发阶段,即致力于改善和解决此类问题,包括引入人类专家意见反馈机制和强化学习(RLHF),引导AI输出准确内容。目前,部分生成类AI还加入了输入(prompt)+输出双重过滤机制,来进一步避免出现有害内容或侵权问题。尽管大语言模型的进步速度令人瞠目结舌,仅用了4个月,ChatGPT 4相比于GPT3.5,其输出信息的准确率就大幅提升了40%,违反内容政策的输出可能性降低82%[7],但目前仍不能保证其生成内容具有可靠的准确性。因此作为用户也应当对ChatGPT的回答保持一定警惕和判断力,避免被误导。

综上,看待生成式AI的数据合规问题,需要从移动互联网服务中的数据合规惯性中跳脱出来,围绕其在隐私和数据安全方面的不同特点,有的放矢采取相应的合规和安全保护措施。

面向未来的挑战:

前所未有的数据汇聚

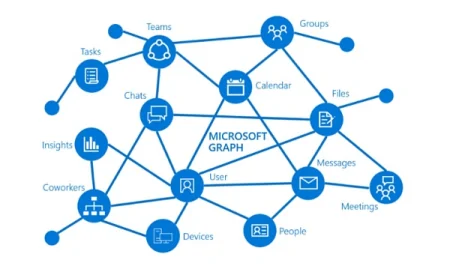

基于大语言模型的生成式AI为世人所瞩目,不在内容生成,而在其所具有的通用人工智能(Artificiall general interlligence,AGI)潜力,业界惊呼:AGI的奇点时刻正在到来。未来,除了面向普通大众的内容生成式AI应用外,业界普遍认为AI也将改写互联网范式。现有商业模式将广泛引入AI智能模型,大幅提升用户交互效率。这不是将来时,而是进行时。2023年3月17日,微软发布Microsoft 365 Copilot,将大语言模型(LLM)功能与微软办公应用相结合,帮助用户解锁生产力[8]。

Copilot将会被内置到办公全家桶内,在Word、Excel、PowerPoint中,AI将与个人通过便捷的语言交互,一起撰写文档,演示文稿,实现数据可视化;在Outlook,Teams ,Business Chat中,AI能够帮助用户回复邮件,管理邮箱,实时完成会议摘要和待办事项,提高会议效率。

办公效率的飞越提升,不仅建立在强大的AI模型能力基础之上,更建立在广泛的数据打通链接基础之上,使用Copilot意味着用户将授权微软打通跨越各业务平台的个人数据。正如微软隐私政策所陈述,为实现业务提供,改进和开发产品等目的,微软会从不同的业务环境中(例如在使用两个以上 Microsoft 产品的过程中)收集的数据进行合并[9]。

这只是未来超级数字助理的雏形,在智能基础设施的支持之下,每个人甚至可以拥有多个数字分身,协同完成任务。可以想见,数字助理的背后是大语言模型访问、链接个人以及商业企业的私有数据,数据的融合利用一定是无缝丝滑的。此类数据的访问处理如何以安全、合规、保护隐私的方式进行,对安全技术保障措施提出了更高要求。

图:Microsoft Graph 是 Microsoft 365中数据和智能的网关。它提供了统一的可编程性模型,以安全便捷地跨业务平台访问数据。

同时,我们也迫切需要审视现有的隐私保护与合规机制。在当前移动互联网个人信息保护实践中,对于必要性原则解释是非常严苛的,以最大程度的避免数据收集与汇聚。例如:《常见类型移动互联网应用程序必要个人信息范围规定》(简称《39类规定》)不仅针对每类应用区分了基本功能和附加功能,还针对基本功能收集的必要信息进行了明确。在大部分基本功能中仅能收集两三类个人信息,例如定位和导航功能仅能收集位置信息、出发地、到达地三种信息;《App违法违规收集使用个人信息行为认定方法》中更是明确:不得仅以改善服务质量、研发新产品等理由收集个人信息。这种基于“严防死守”的数据合规思路在未来的AI应用场景中是否还能继续走下去,是一个值得探讨的问题。

从移动互联网到我们正在步入的AI时代,虽然数据利用一直在向更广更深的方向发展,但各类新技术应用仍将隐私保护作为价值对齐(value alignment)的重要方面。隐私和数据安全的真谛从来也不是对数据的使用进行各种限制,或者人为增加数据利用门槛,而在于通过激烈的市场竞争、健全的法律机制和更加强大的技术安全措施来切实保障用户隐私与数据安全。

AI时代,掌握AI大模型第一手资讯!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

扫码右边公众号,驾驭AI生产力!