科技巨头Google的道德困境:从「Don’tBeEvil」到「Dotherightthing」

文章主题:关键词:Google, 口号, 道德, AI

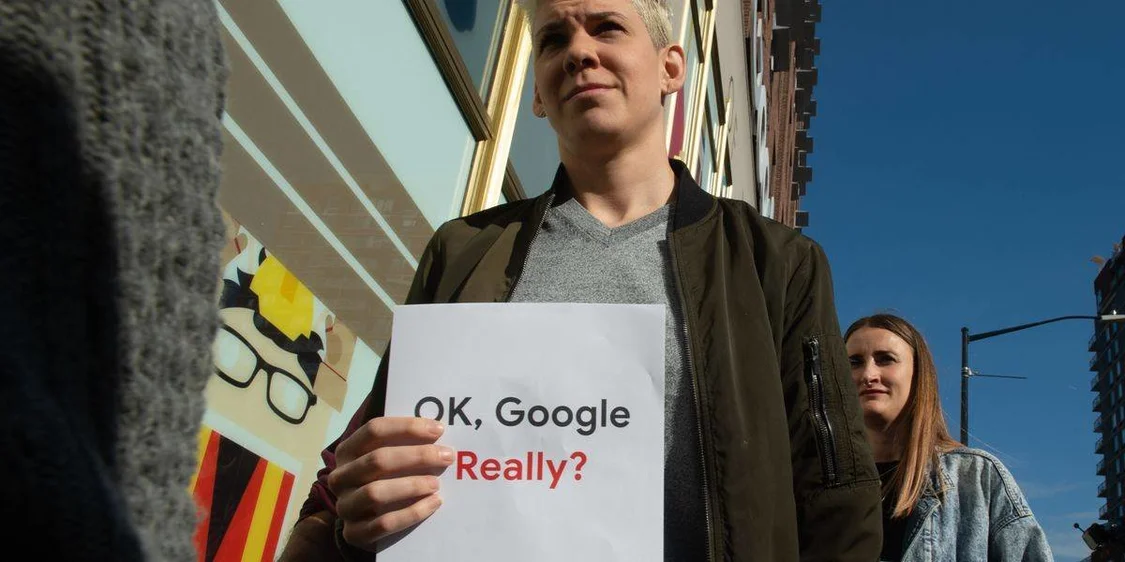

“Don’t Be Evil”(不做恶)这一口号,自2018年起,曾是Google的信仰和行动指南。

图片来自:substack

这指的是 Google 在做事时要遵循道德和法律,不做有害社会和用户的事情。

但到了 2018 年,这个话术被修改为「Do the right thing(做正确的事情)」。

Google 的这个变化,被许多人认为它已经违背初心。

图片来自:vox

在后续的商业活动中,Google并未保持其技术的中立性,反而更倾向于追求商业利益,包括收集用户隐私,以及运用各种数据来推动自身业务的扩展。这种做法引发了广泛的争议,因为技术的 neutrality 是保证互联网健康发展的关键之一。

我之所以提到 Google 的这句经典口号,是因为当前人工智能领域的快速崛起,与互联网行业的爆发似乎有着相似的节奏。这种现象的出现并非偶然,而是与当今科技发展的大背景紧密相连。

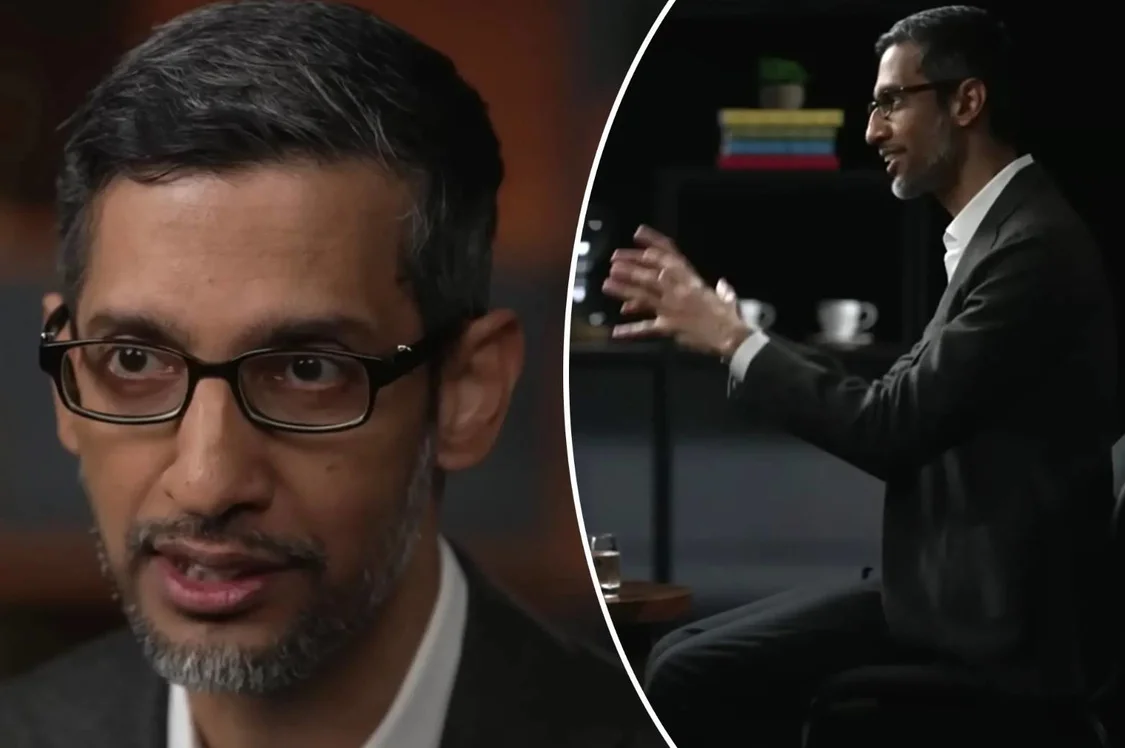

在一次对CBS《60分钟》节目的采访中,Google现任CEO Sundar Pichai谈到了当前AI的发展,并再次强调了公司所秉持的“Do No Evil”原则。

事实上,Google Bard 的表现略显笨拙,这主要是因为其高级版本尚未公开。

「希望能够给社会更多的时间适应 AI,和给公司更多的时间开发安全围栏。」

总之,Pichai 认为 Google 在 AI 领域与 OpenAI 相差无几,并将 AI 技术暂时封印,出于履行社会责任的考虑。

但,无论是从彭博、the Verge、金融时报各方面的报道来看,Google 内部却对 Bard,以及 Google 当下对 AI 技术的开发和监管,却有着截然不同的声音。

为了抗衡 ChatGPT,伦理道德可以先放一边

大概在 2011 年,Google 就创立了 Google Brain 项目,着手于深度学习领域,也意味着 Google 开始涉足 AI。

从此往后,Google 几乎每年都在 AI 领域取得一些小成果和达成小目标。

从 AlphaGo 下棋赢了世界冠军李世石,到发布 TensorFlow 开源框架,再到机器学习芯片 TPU 的发布,和近期 BERT、LaMDA 等语言模型。

Google 在 AI 领域可谓是轻车熟路的老手,在研究 AI 的过程中,其内部也有了较为完善的风险团队、技术团队等等,可谓兵强马壮。

当然,也有点不可一世。

每年 Google 开发者大会的内容,也开始转向 AI,向外界展示 Google 在 AI 领域的深厚实力。

外界也普遍认为,Google 会率先引领 AI 行业变革。

直到 ChatGPT,准确的说是 GPT-3 的横空出世,以及后续 GPT-4 的出现,Midjourney V5 的火热。

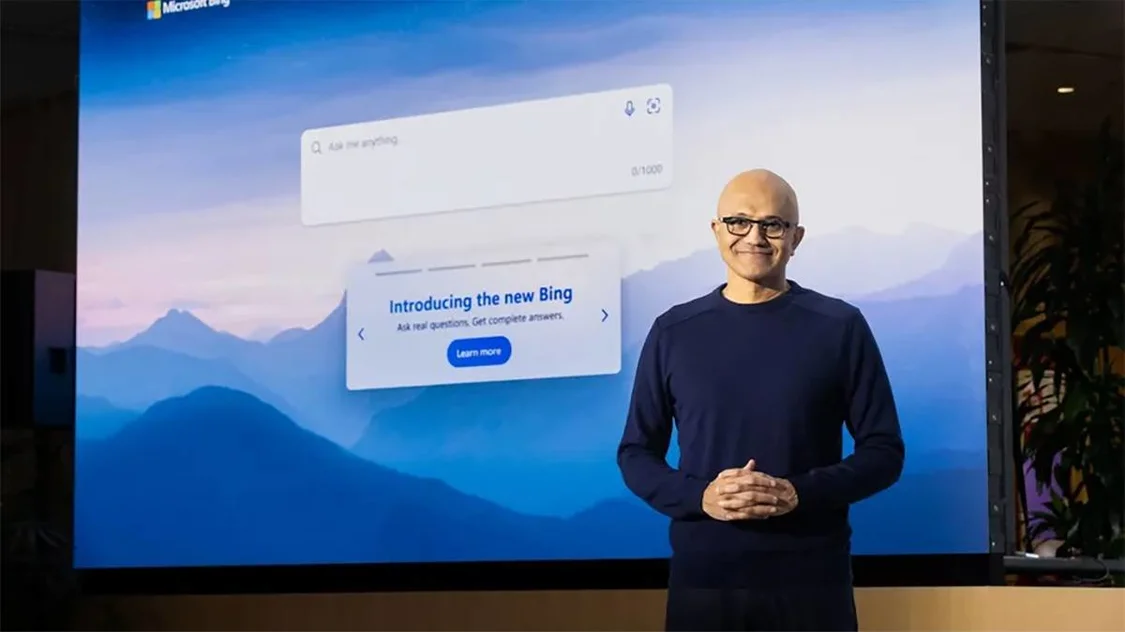

还没等 Google 反应过来,微软就抓住机会,与 OpenAI 合作,将 ChatGPT 运用到了新 bing 当中,引发了一次「搜索」变革。

当 Google 回过神,连夜推出了 Bard,刚一上线就闹了乌龙,出现了不少事实性错误,并且至今只支持英语。

相对于 ChatGPT、新 bing 来说,逊色太多。

仓促推出 Bard 的结局,就是引发信任危机,股价大跌,即便后续 Google 即使调整,Bard 的影响仍然不能与 ChatGPT 相提并论。

造成如此的局面,Google 内部的一些员工也表示,Bard 压根就没能通过一些道德基准测试,很容易说谎,和发出负面言论。

在内部测试的过程中,一位员工向 Bard 寻求如何降落飞机,它回答出的步骤,极容易导致坠机。

而另外一位员工问 Bard 潜水问题时,它则会给出容易导致严重伤害或者死亡的答案。

除了这些危险的答案,在一些道德伦理和社会问题上,Google 也放松了要求。

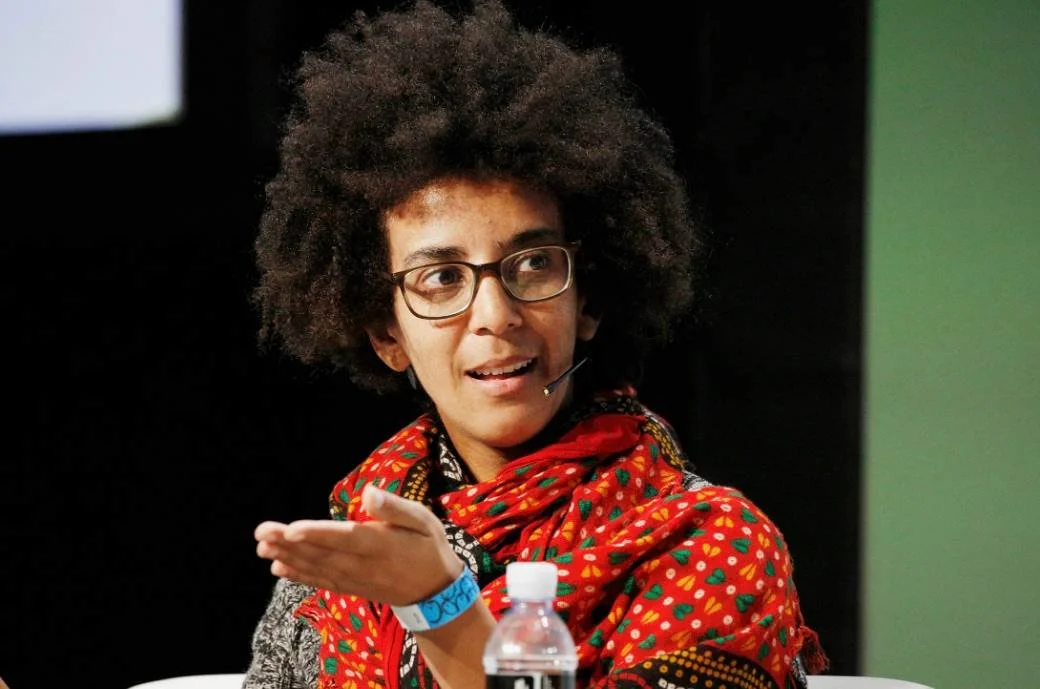

在 Google 内部,有一个 AI 道德研究团队,他们会探索、确立、评估 AI 所带来的风险。

他们有权利直接为一项技术打上红色标签,未能通过测试就暂时不去面向公众。

Google 前 AI 道德团队研究员 Timnit Gebru 图片来自:Bloomberg

Google 在 2021 年也承诺为 AI 道德研究团队扩充,并投入更多的资源,以钳制技术研究人员的逐利。

但有意思的是,该团队的领导人一直在更换,并且也在去年经历过一轮裁员。

目前 Google AI 相关技术研究人员要比道德安全团队多出 30 倍。

甚至在 ChatGPT 抢尽 AIGC 行业风头之后,Google 也开始动摇,道德团队的人员被告知不要阻挠或者「杀掉」正在开发的的任何生成式 AI 工具。

而在经历内部测试,收到了不少「质疑」之后,Google 面对微软和 ChatGPT 的商业压力,最终也选择以「实验产品」的名义对外发布。

因为在一些统计调查里,实验产品即便有着缺陷,也更容易被大众接受。

并且一些员工也认为新技术尽快公布于众,可以快速获得反馈,能够更快的更迭改进产品。

实际当中,在 Bard 发布之后的相当长时间内,Google 也只进行了一次更迭,为其增加了数学逻辑的修改。

至于一些敏感围栏、敏感主题是否有改变和优化,并未有提及。

Bard 在每日一变的 AI 浪潮里似乎也正在被边缘化。

马斯克:ta 必须要监管

有趣的是,几乎与 Pichai 的访谈前后脚,马斯克也在 Fox 新闻上谈到了 Google。

马斯克与 Google 创始人 Larry Page 曾经是密友,Page 甚至买了 10% 的 SpaceX 股票,还想跟马斯克一起去火星玩沙子。

但在 2014 年,Google 收购 DeepMind 后,二人对 AI 的看法发生了分歧,并最终不相往来。

同年,Page 在 TED 演讲中表示,他的终极目标是建造一个超级数字人工智能,称之为「数字之神(digital god)」。

而对于这个想法,Pichai 在《60 分钟》的采访中,并没有否认,也没有认同。

反而他只表示,Google 将会在 5 月 10 日举行的开发者 I/O 大会发布新的 AI 产品。

而马斯克对于「数字神」有着清晰的认知,Google 有着世界接近垄断的高性能计算机与人工智能团队,也最有可能达成所谓的「数字之神」。

但公司领导人 Page 却丝毫不关心 AI 所带来的安全问题,这对于世界来说,相当危险。

这也是他最近在看到 ChatGPT、新 bing、Bard 喜欢胡说之后,想要入局,并推出一个名为 TruthGPT 的类似产品。

另外,马斯克也在呼吁各国各组织出台相应的政策来限制当下 AI 的一些出格行为。

由于生成式 AI 的特性,他的数据来自于互联网论坛、论文、网站等方方面内容,由于这些数据没有脱敏,不严格限制,很容易产生有风险、有害或者不准确的言论。

另外,随着当下 AIGC 行业的火热,入局者犹如淘金一般,仿佛人工智能正在进入一个新的发展阶段。

但目前大规模模型、高算力的工业生成方式,也让 AI 很容易被大公司垄断。

当他们内部难以权衡逐利还是维持安全,就很容易在 AI 取向上犯错,造成不可挽回的后果。

纵使马斯克在 AIGC 上有着一丝私心,但在一些大是大非上,马斯克的确要清醒不少。

能力越大,责任越大

Google Photos 会利用 AI 识图进行标记,帮助用户梳理图片进行分类。

这算是 Google 比较早的一个 AI 应用,即便 Google Photos 调整了免费容量,但它仍然是我最常用的一个 App。

但在 2015 年,Google Photos 误将黑人软件开发者和他的朋友的图片标记为「大猩猩」。

比较正常的反应应该是道歉,并重构算法,逐步修复这个识别错误。

但 Google 却选择了将「大猩猩」、「黑猩猩」和「猴子」等搜索结果全部删除。

而如今面对 Google Bard 出现的问题是,Google 仍然没有承担责任的意味,同样还是选择了轻视。

为了能够追赶 ChatGPT,Google 内部存在的 AI 道德团队并没有对其进行全方位的评估,仅进行了敏感主题的研究,便最终匆忙推出。

彭博也引用一位前 AI 道德团队高管的评价,认为 Google 对于发展尖端 AI 还是发展有道德底线的 AI 一直存在着争议。

其实在 AIGC 行业内,不止是 Google,金融时报也曝出,微软、亚马逊等科技巨头都在大规模的裁撤 AI 伦理团队。

仿佛在 AIGC 高速发展,互相竞争的当下,AI 伦理、AI 安全已经影响到了他们互相追逐的枷锁。

就如斯坦福大学研究人员的报告里所言,AI 行业的快速发展,已经从学术转向了工业化,在商业利益的诱惑下,各种 AI 正在涌现,但背后所带来的伦理道德、安全、敏感、有害等信息却逐步被忽视。

大公司们也变得不愿去承担更多的社会责任,仅在法律法规的边缘上徘徊,如此最终可能会给社会和 AI 行业带来深远的影响。

目前多个国家和地区,甚至是一些公司和组织,也正在积极研究制定一些规则来限制 AI 无节制的发展。

也正如前福布斯中文版副主编尹生所言:「大公司必须做得比用户和法律要求的更多,因为你创建了一个新世界,并从中获益,你必须帮助整个社会学会如何治理它,如果你不主动做,社会就会接管过去。」

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!

转载请注明:科技巨头Google的道德困境:从「Don’tBeEvil」到「Dotherightthing」 | ChatGPT资源导航