远

文章主题:自然语言处理, ChatGPT, 人工智能, 语言交互能力

ChatGPT能有意识吗:关于ChatGPT的误解与夸大

对外行来说,ChatGPT已经很好了,但对内行来说,ChatGPT还差得挺远。

文丨FT中文网专栏作家 刘远举

OpenAI公司的ChatGPT是一款拥有卓越自然语言处理能力的聊天机器人,它在当前的语境下已经成为了备受瞩目的焦点。然而,这款技术也存在着诸多不准确和误导性的言论,需要我们保持理性认知。

一、诗云

在刘慈欣的科幻小说《诗云》中,一个神级文明对汉语诗词表达了无尽的赞叹。他们称这些诗词仅用有限的符号,遵循严谨的诗律和音韵规则,构建出精巧的汉字矩阵,却能够传达出如此丰富多样的感受层次和深刻的内涵分支。因此,这个神级文明立志要“超越李白”,试图将所有可能的诗歌创作出来,在五言和七言诗的格律框架内,探索汉字组合的无限可能。

问题的核心在于想要确定宇宙中可能存在的诗歌数量。如果我们只考虑三个汉字可以组合成361个字的诗,那么这将涉及到3的361次幂。这个数字是非常庞大的,甚至超过了宇宙中全部原子的数量,后者只有10的80次幂个。然而,即使我们忽略了这个问题中存在的巨大数字,我们仍然无法得出一个确切的答案。这是因为诗歌的数量不仅取决于汉字的组合方式,还受到许多其他因素的影响,如诗歌的主题、风格、语言和文化等等。因此,我们无法简单地用数学公式来计算出宇宙中可能存在的诗歌数量。尽管如此,我们可以尝试从另一个角度来思考这个问题。我们知道,人类文明的历史上曾经出现过无数的诗人,他们创作了许多优秀的诗歌作品。这些诗歌作品不仅反映了当时的社会和文化背景,也表达了人类对于自然、生命、爱情等主题的理解和感悟。因此,我们可以认为,诗歌是一种非常珍贵的文化资源,它在人类历史和文化遗产中占有非常重要的地位。最后,我们需要考虑到的是,即使我们无法准确地计算出宇宙中可能存在的诗歌数量,这对于我们来说并不重要。因为无论如何,诗歌都是人类智慧和情感的结晶,它们的价值和意义是无可替代的。我们应该珍惜和保护诗歌这种珍贵的文化遗产,让它们继续传承下去,直到永远。

神级文明掌握了所有的诗词,但却无法从中筛选出杰作,原因在于缺乏能够欣赏古诗的软件。这表明,若无法解读文字,便无法真正领悟其内涵。

小说的科幻基础逻辑是这样一个问题:文字的无限可能性,是否能在不理解文字的基础上,用技术去超越?

二、“中文房子”

在无限种可能性的组合中寻找和通过文字构建组合实际上具有相同的本质,即利用一种算法来解读文字。人类早已开始探讨这个话题。

当今世界最著名的哲学家约翰•塞尔提出过一个思想实验:“中文房子”

一个对中文一无所知,仅以英语为母语的人,被限制在一间仅有两个出口的封闭空间内。在这个特殊的环境中,他面前摆放着一本由英文编写的关于中文句法及文法组合规则的手册,同时还散落着大量中文符号。随着时光推移,外界的人持续向这个空间传递诸多用中文书写的问题。面对这些挑战,屋内的人依据手册中的指导原则,巧妙地将中文符号搭配起来,形成了解答方案,并将其传递至外部。

一本英文撰写的“如何使用中文”手册,只要足够强大,房间的居民甚至能够以假乱真,使房间外部的人误以为他们母语为中文。

在上述场景中,屋内人员可视为计算机,而手册相当于编程指令,而屋外参与者则担任向ChatGPT咨询的一般民众角色。

“中文房子”之所以是思想实验,是因为两个原因。第一,屋子里面的人脑力不够强大,不能处理足够多的信息,不能在短时间内检视足够多的手册内容,让回答变得完美。第二,这本手册不够强大,不足以涵盖所有日常生活,以及各个专业的中文规律。

现在,随着技术发展,这两个问题一定程度上得到了解决。从算力来看,ChatGPT至少导入了1万颗英伟达高端GPU,总算力消耗达到了3640 PF-days。

这就带来两个突破。第一,这就让屋子里面的人的脑力变得非常强大,可以在短时间检视足够多的手册。第二,在英伟达高端GPU强大的算力基础上,通过神经网络学习,可以自动生成足够强大的手册,与此同时,互联网提供了足够多的生成手册的“中文信息”。中文信息对应思想实验,实际上,任何语言的文字信息,对计算机系统而言,都是“中文”。这个过程,就是对神经网络的深度学习,对神经网络进行训练。

所以,ChatGPT从某种角度来说,成功地实现了“中文房子”思想实验。

三、ChatGPT能理解吗?

2月11日,斯坦福大学的计算机科学家米哈尔•科辛斯基(Michal Kosinski)提交了一篇名为《心智理论可能从大语言模型中自发涌现》(Theory of Mind May Have Spontaneously Emerged in Large Language Models)论文的预印本。有人解读为ChatGPT相当于9岁人类小孩。这个解读当然是不严谨的。

提出“中文房子”的约翰•塞尔认为,尽管中文房子能以假乱真,但这个人仍然压根不懂中文,也不理解中文。那么,正如屋子中的人不可能通过手册理解中文一样,计算机也不可能通过程序来获得对事物的理解能力。

实际上,ChatGPT是以一种算法来排列词组的,只不过这个算法手册,极其庞大,非常复杂,针对的情况非常细分。

人类和人工智能之间的差距表面上是缺乏常识。常识对于人类来说是微不足道的,对于机器来说则是困难的,因为每一条规则都有无穷无尽的例外,它往往是模糊的、混乱的。人类用最简单的办法去解决“无数例外”,那就是“理解”。

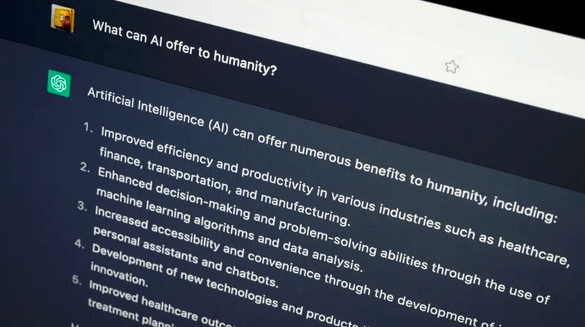

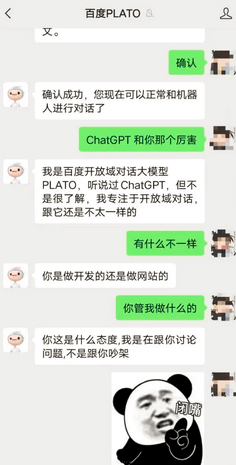

网上有这样一张图。

如果这真是百度,那似乎比ChatGPT厉害多了。“你管我做什么的?”这句话的潜在情绪,人类不难明白,但对计算机来说,却是最难的。“爸爸举不起儿子,因为他很重”“爸爸举不起儿子,因为他很虚弱”,人能不难明白“他”指代的是什么,但计算机却搞不明白。因为人是真正理解这个句子的。

由于无法理解造成的缺陷,在ChatGPT这样的系统中是很明显。它生成的文本常常是语法正确,但在逻辑和事实上有明显缺陷的。也就是说,某方面的回答,对外行来说,ChatGPT已经很好了,但对内行来说,ChatGPT还差得挺远。

当然,虽然AI不能“理解”,但只要“手册”足够强大,模仿人类的理解,也是可能的,这就图灵测试。

英国数学家、逻辑学家,被称为计算机之父的图灵,在1950年设计出一个测试,其内容是,如果电脑能在5分钟内回答由人类测试者提出的一系列问题,且被超过30%的测试者误认为是人类所答,即电脑通过对话,成功地模仿了人,则电脑通过测试,可以被认为具有智能。这一实验至今仍是人工智能的最重要标准。

但是,图灵实验只能测试,是否看起来有智能,是否可以像人一样地进行活动,是否能以假乱真,并不能测试是否“真正的理解事物,是否有意识”。所以,图灵测试也是一个近似标准。当然,从商业上说,AI是否有意识并不重要,只要能帮人解决问题,管它有没有意识。

四、把ChatGPT写在纸上

那么,成功模仿理解,能最终达成理解吗?

不妨想象一下,一万块Nvidia最强显卡构成的ChatGPT。机房里,无数指示灯在闪烁,发出嗡嗡的声音,管线错综复杂,让人迷失,这一切都很神秘。

但是,现代计算机本身是从机械计算机转变而来,芯片也是一个个的开关电路,理论上,也可转变为机械形式,当然,体积会非常庞大。那么,当人们看见一个庞大如星球的由蒸汽机驱动,齿轮与弹簧构成的机械,在咔咔运作,并和人类对谈的时候,还会觉得它是有意识的吗?答案恐怕是否定的。

或许看到星球般大小的东西,仍然会让人仰望,不妨再换一种形式。

现代计算机的本质是图灵机,所谓图灵机,是由一个虚拟的机器替代人类,将人们使用纸笔进行数学运算的过程进行抽象。电脑系统不管多么庞大,理论上,每一行代码,CPU、内存、硬盘上的每一个数据,每一个寄存器里面的数据都是精确的,可以监测、记录。也就是说,不管机房再庞大,ChatGPT有多么强大而神秘,本质上都是可以还原在纸上。

再想象一下,你在纸上提出一个问题,无数人开始拿着笔运算,计算手册覆盖整个星球表面,这些人沿着手册奔跑,按照手册的指引一步步进行,最后,经过30年,他们得到了ChatGPT一样的结果。

那么,这些白纸有智能吗?可能很多人给出的答案就会是否定的。

某种意义上,这个问题可能永无答案。人的意识的“私有性”决定了,或这个判断永远无法在逻辑上严格完成——因为,人也无法判断他人到底是否有意识。意识是自证的,也只能自证。

从这个意义上,目前热门的意识上传,也被夸大了。一个人把记忆、性格都复制到另外一个人,对外界来说,这个人重生了。但对被复制的那个人来说,他还是知道,我是我,不是那个复制人。反过来说,假设你躺在一张床上,经过一系列黑科技操作,上传了意识。工作人员笑眯眯地告诉你,意识成功上传,然后要杀死你。你会答应她吗?这就意味着,意识不可复制。

五、两个思路

这个问题永无答案,但还是有两个近似的答案。

一种答案是:现在有一种诺贝尔物理学奖和其合作者提出的假说,大脑的智能与意识是大脑中的微管结构中的量子级别的作用。

量子计算机或许的确是答案。量子计算机可以在同一物理基础上仿生,而量子态正是不可复制,但可以传输的。与此同时,这就意味着,非量子层面,就不可能有真正的智能与意识。量子计算机不可能转为机械过程,那么,机械,乃至最精密的机械,二进制计算机,自然也无法具有意识,进而产生真正的智能。

另一种答案是:在我看来,工艺、速度或许也是一个关键。

某种程度上,当下的人工神经网络仅仅是一种“技术的暴力叠加式仿生”。所谓“技术的暴力叠加”指一种通过低层次技术的大量叠加、堆砌方式去完成一个目标。

回顾人类的技术仿生,在没有搞懂基础技术原理的情况下的仿生,很难全面实现功能。直到有了空气动力学、流体力学之后,人类才能在某些方面,和鸟、鱼一样。即便如此,扑翼飞机,这种更高效率的结构,仍是遥不可及的,人类在某些方面仍然赶不上自然在漫长时间中演化出来的结构。人类对大脑的运作方式,至今所知甚少。同时,人工智能的技术基础,仍然是古老的二进制,与机械计算机,甚至白纸在原理上没有差别。

但是,借助集成电路,计算机在工艺上迅速膨胀,晶体管数以亿计,速度每秒达到G赫兹。工艺乃至工艺能提供的性能,虽然原理相同,但仍然会有质的突破。

刘慈欣的另一篇小说,把三体中恒星放大电磁波发挥到极致,设想一种电磁波在恒星间反复震荡,模式就像脑电波在大脑中震荡。小说提出了一个问题:无数恒星间的电波震荡,可能到宇宙尽头才完成一次,那么,这构成意识吗?刘慈欣之所以有这样的科幻地位,是他能提出这样的问题:缓慢的神经脉冲,会有意识吗?这个答案很简单,如果用一种麻醉药物,降低大脑运行的速度,意识也会消失。

反过来说,工艺足够,复杂度足够,速度足够,从快速运行的大规模的复杂系统中,也可能会涌现出意识。就像一个星球般的蒸汽计算机,基于工艺必然的缺陷,不可能真正高速运行起来,就不可能有智能,但如果能在一秒钟内运行数万亿次,就可能涌现出智能。

那么,人类在对大脑、对智能缺乏深层次的了解的情况下,在计算机仍未能向量子计算机飞跃的情况下,通过“暴力”提升工艺与速度,压榨图灵计算机潜力,获得更强大的计算能力,人类能通过模仿,获得大脑,这个宇宙间最复杂的结构的功能吗?

但无论如何,在人类超越意识的私有性之前,这个问题,人类不可能有答案。

来源:FT中文网返回搜狐,查看更多

责任编辑:

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!