文章主题:数学, LLM, ChatGPT

克雷西 发自 凹非寺

量子位 | 公众号 QbitAI

北大团队教会AI把人话当编程语言用。

这下大语言模型(LLM)不光能做对数学题,而且解题过程你也能看懂!

数学,曾经是不知多少人学生时代的梦魇。但是现在,LLM或许可以帮你脱离苦海了。

🌟自然语言编程并非单纯描述步骤就能轻松驾驭的领域,尽管像GPT3.5这样的先进模型看似具备这种能力。然而,实际的表现却让人遗憾,常常会出现遗漏关键步骤或令人费解的误导信息。🔍这些错误不仅破坏了逻辑连贯性,也对结果的准确性构成威胁。我们需要更精确、全面的工具来确保编程过程的顺畅与成功。💡

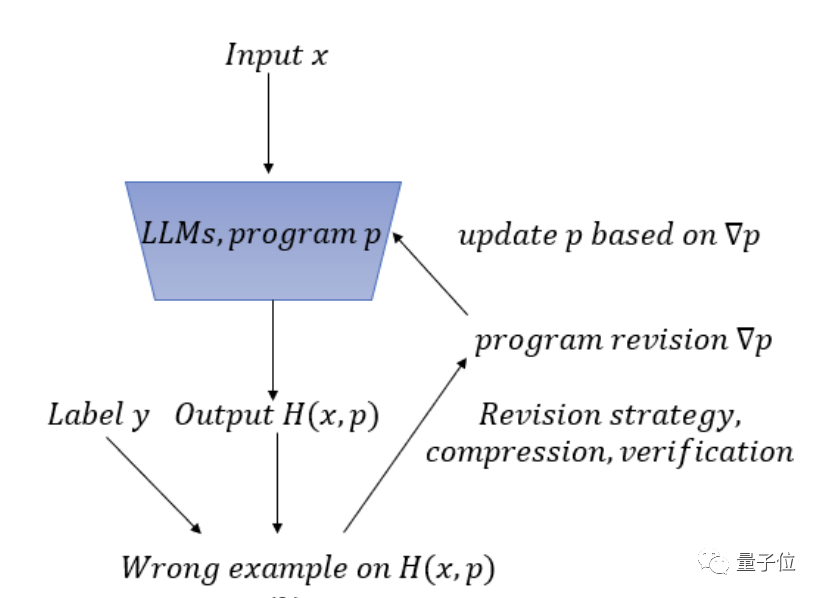

于是团队便提出了Learning to Program (LP)方法,让LLM从自然语言程序数据集中进行学习,并用学到的内容指导其推理过程。

具体来说,他们将一些高中数学问题和对应解题程序以自然语言形式灌输给GPT。

经过训练,ChatGPT具备了团队预期的解题能力。

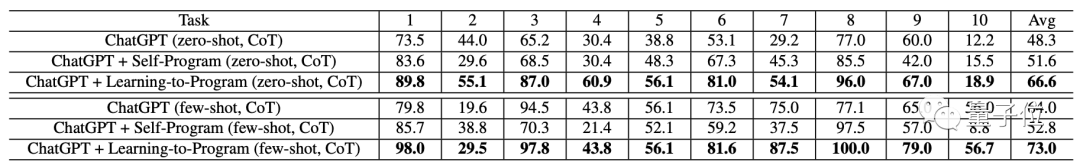

在使用10个高中难度的数学问题进行的零样本测试中,LP加持后的LLM成绩显著提高。

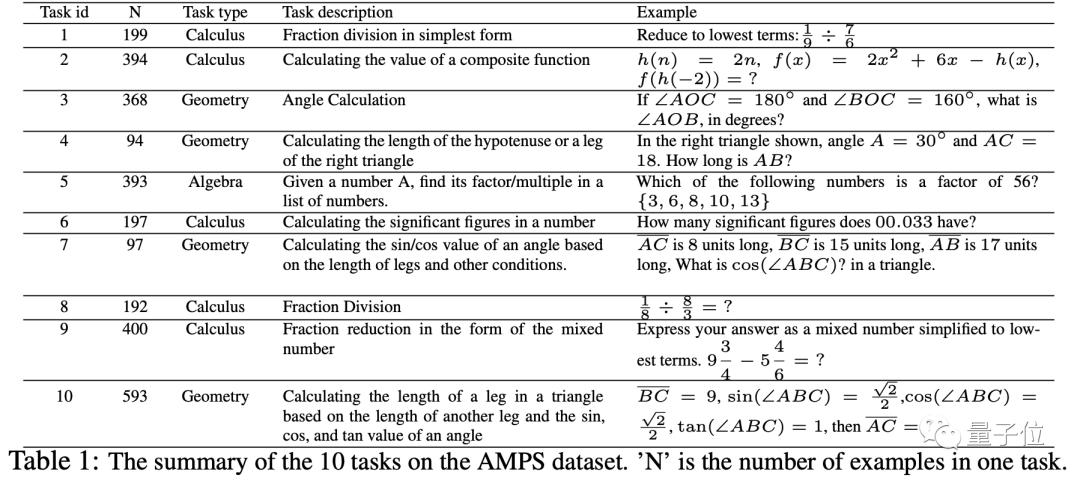

这10个问题包括几何、代数和微积分,具体如下表所示:

🌟ChatGPT在每项任务中的卓越表现无可忽视,特别是在零样本和少样本测试中,其LP加持的优势明显展现出来。相较于单一的独立运行或是自我编程能力,它展现出更强大的实力和适应性。SEO优化的语言中,我们可以说:无论环境下如何挑战,ChatGPT凭借LP的支持,总能以优异成绩超越传统算法。

对于第8类问题,LP加持版更是在少样本测试中取得了100分的成绩。

🌟团队挑战升级!🌟通过深入探究中级代数( öz IA)、数论( NT 黑洞)与几何的秘密,我们对 ChatGPT 进行了严苛测试。令人惊喜的是,它在所有领域都展现出了卓越实力,甚至在统计概率( CP 的迷宫)中也保持了相当竞争力。相较于单一优势,ChatGPT 现在的表现更显均衡且强大!🏆

当然,这些数据还不能证明LP训练在提高ChatGPT数学成绩当中的关联性。

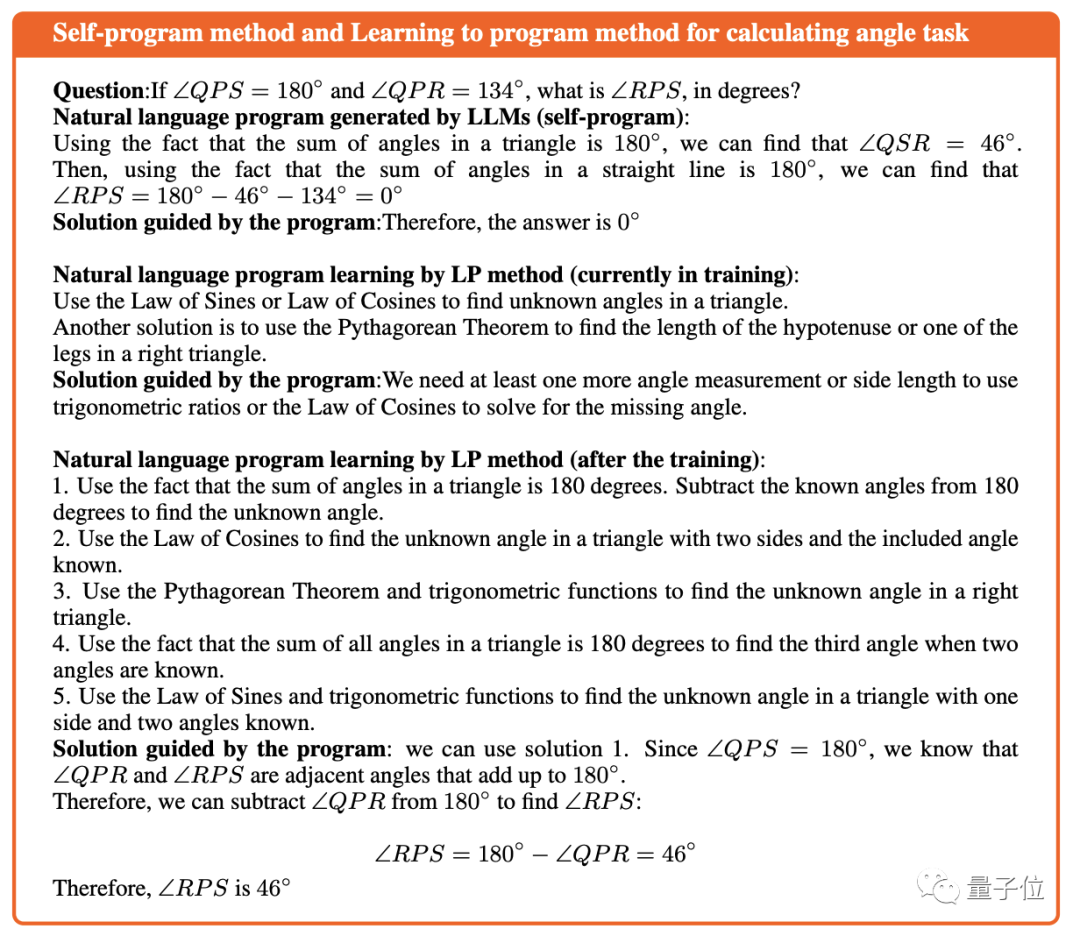

于是团队使用一道几何问题,评估了ChatGPT在LP训练前、中、后三个阶段的表现。

结果显示,输出内容的正确率的确随着训练过程的进行在逐步提高。

在接下来的质量评价中,训练后的LLM可以给出多种通用性策略。

因此,团队认为,在今后的训练中,只需要将某一类问题的通用解法教给LLM。

有了通用方法,它们就可以举一反三,解决未知但性质相同的问题。

LP的训练过程是怎样的

LP训练的第一步,是要先准备出问题,以及对应的用自然语言编写出的程序,作为训练数据集。

这种自然语言程序不是具体的解题步骤,它们需要具有更强的通用性。

相应的,准备的问题也不是具体的,而是某一类问题。

既要简短明确,同时又要考虑到实际过程中所有可能出现的情况。

这些自然语言程序主要有三种来源:机器自生成、人工编写和经LP训练的LLM生成。

人工编写工作量过于庞大,LP训练已经是结果,所以实际使用的数据集主要来源于第一种途径。

有了训练数据,LLM便可以结合数据集中的问题,学习句子、段落和公式。

初步学习完成之后,就要让LLM进行预测,并与预设结果比较,计算误差。

同时,所有不符合预设正确结果的输出均被收集,构成了错误数据集。

错误数据集在之后的阶段也将作为LLM学习的内容,以避免再次出现同样的失误。

基于这些错误数据,研究人员让LLM对所提出的策略进行回溯,但又引发了新的问题:

一是出现了重复的解决方案需要移除,二是有些方案自身内容虽然没错,但与问题并不匹配。

最重要的第三点,是输入数据的长度会随着回溯的过程不断增加……

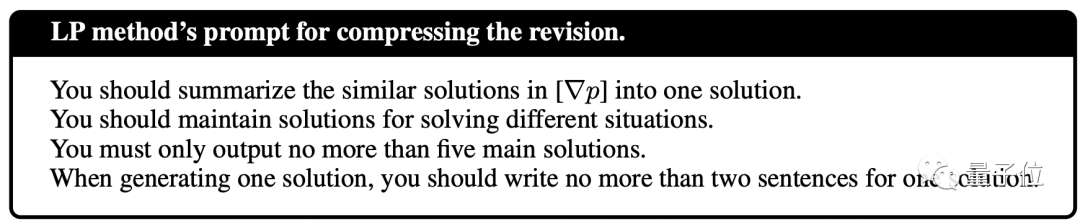

于是团队还需要对回溯数据进行压缩,并判断它们对LLM改正错误是否有帮助。

经过这一系列的处理,便可以将回溯数据作为训练样本,升级LLM程序了。

最终,升级后的程序经过检验,就可以使用了。

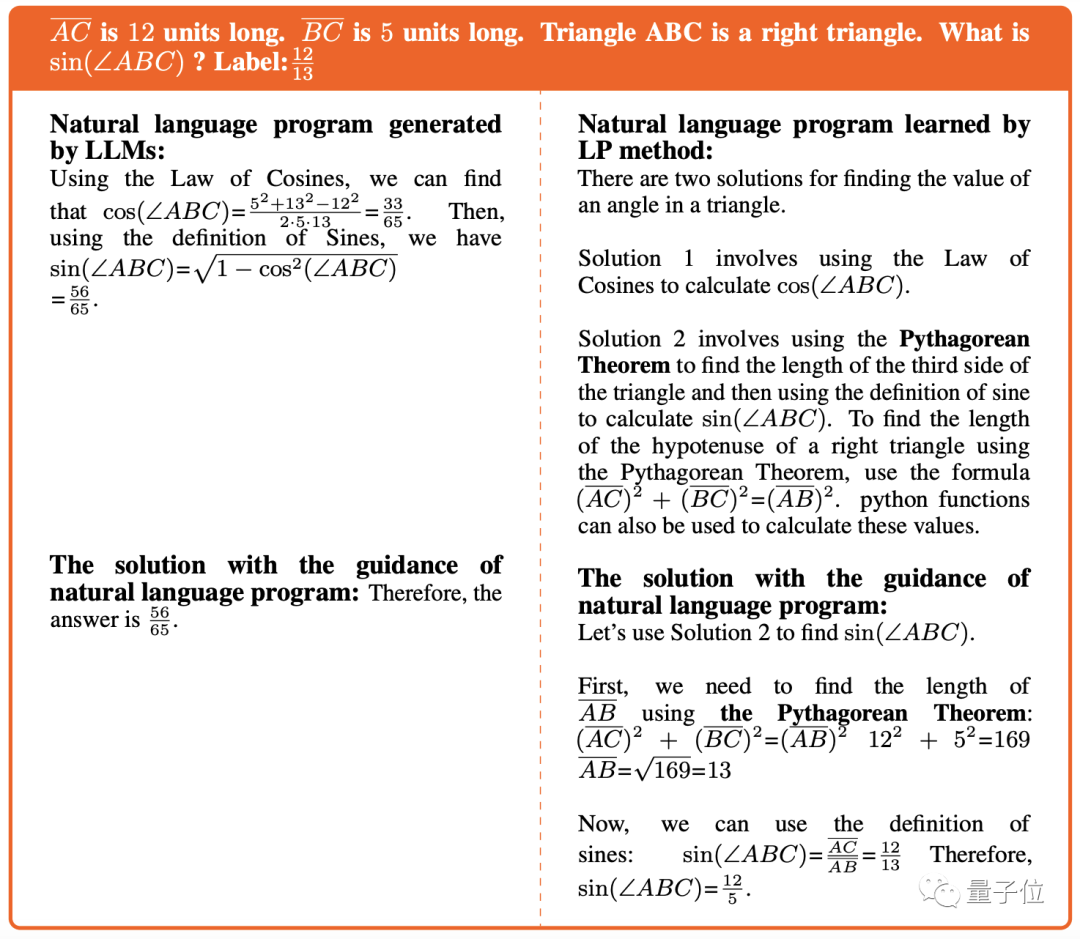

△举个例子:已知直角三角形两边,求某角正弦值

团队介绍

团队的领导者是北京大学王选计算机研究所博士生导师赵东岩研究员和微软亚洲研究院首席研究员段楠博士。

🎓北大学子赵东岩,2000年以卓越成就斩获博士学位,专长领域聚焦于自然语言处理与大数据语义管理,致力于推动基于知识的智能化服务技术的发展。他的学术贡献和专业造诣,无疑为相关领域留下了深刻印记。SEO优化后:🌟北大博士赵东岩,2000年领航NLP与大规模语义研究,专注于智能服务领域的知识驱动技术创新。他的深度洞见与实践贡献,对行业产生了深远影响。

段楠博士毕业于天津大学,于2012年进入微软一直研究院,并在2018年6月晋升为首席研究员。

此外,他还多次担任NLP/AI学术会议程序主席,发表学术论文100余篇,持有专利20余项。

论文地址:https://arxiv.org/abs/2304.10464

参考链接:[1]https://www.microsoft.com/en-us/research/people/nanduan/[2]https://www.wict.pku.edu.cn/zhaodongyan/[3]https://www.linkedin.com/in/nan-duan-322739a/details/experience/

— 完 —

量子位 QbitAI · 头条号签约

关注我们,第一时间获知前沿科技动态

AI时代,掌握AI大模型第一手资讯!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

扫码右边公众号,驾驭AI生产力!