文章标签:中国, 人工智能, 《布莱奇利宣言》

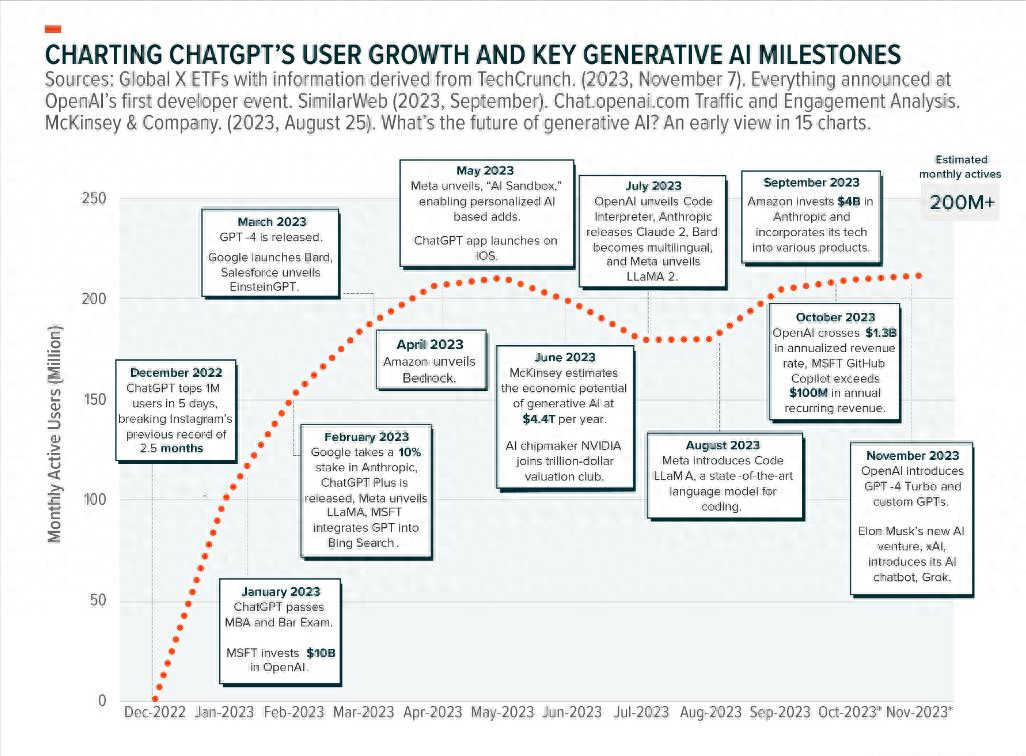

ChatGPT 推出仅两个月内,每月就有 1 亿用户。时间快进一年,用户群现已激增至令人印象深刻的 2 亿。这种显着的增长不仅令大型科技公司感到惊讶,也让政策制定者感到惊讶。深入研究塑造行业和监管框架的趋势。

随着 ChatGPT 一周年,其影响的重要性怎么强调都不为过。最初作为人工智能领域的开创性一步,现已迅速发展成为无处不在的存在,将人工智能的抽象概念转变为许多人的日常现实,或者至少成为每个人谈论的话题。

该平台成为历史上采用速度最快的应用程序虽然 ChatGPT 和类似的大型语言模型 (LLM) 已经揭示了人工智能的可能性,但它们是新技术革命的支柱。所有预测都表明这些模型将变得越来越个性化和针对具体情况。利用专有数据进行精细模型训练和行业特定的自动化。

自 2022 年 11 月公开发布以来,ChatGPT 经历了重大演变。最初,它仅作为文本生成器运行,仅限于从 2021 年 9 月之前收集的训练数据中得出的响应。最初,它表现出在缺乏答案时捏造信息的倾向,在谈话时在话语中引入了一个新术语“幻觉”关于人工智能。

目前,ChatGPT 的演进迭代已训练至 2023 年 4 月,拥有扩展的功能。现在,它利用微软的 Bing 搜索引擎和互联网资源来访问更多最新信息。此外,它已经成为一个产品平台,可以将图像或文档集成到搜索中,并通过口语促进对话。

争夺人工智能主导地位的技术竞赛

2022年1月,ChatGPT月用户数突破1亿。人们对生成式人工智能的兴趣突然激增,令各大科技公司感到惊讶。除了 ChatGPT 之外,还发布了其他几个值得注意的生成式 AI 模型,例如 Midjourney、Stable Diffusion 和 Google 的 Bard。这些发展正在重塑技术领域。科技巨头将所有资源投入到他们认为的关键的未来技术基础设施中,并塑造人工智能革命的叙事。然而,迫在眉睫的一个重大挑战是,在这一领域,只有少数几家公司可能占据主导地位。

2023 年上半年,风险投资家对生成式人工智能公司的投资几乎是去年同期的五倍。即使排除微软 1 月份公布的 100 亿美元投资,风险投资资金仍较 2022 年上半年增长近 58%。

预期的经济影响是巨大的,普华永道预测,到 2030 年,人工智能可能使全球经济增长超过 15 万亿美元。最大的经济体——美国和中国正处于这场新的“人工智能军备竞赛”的最前沿。

根据《2023年人工智能指数报告》,美国和中国在人工智能投资方面一直备受关注,其中美国自2013年以来处于领先地位,4643家公司累计投资近2500亿美元。投资势头没有放缓的迹象。2022 年,美国涌现了524 家新的人工智能初创企业,从非政府资金中获得了高达 470 亿美元的资金。与此同时,中国也出现了可观的投资趋势,2022 年有 160 家新成立的人工智能初创公司平均每家获得 7100 万美元的投资。

许多新的初创公司正在利用 ChatGPT API 并为用户构建特定的用例场景。

人工智能治理——监管还是不监管

在人工智能令人难以置信的进步之中,也存在着令人担忧的阴影。对人工智能产生误导性或不适当内容(通常被称为“幻觉”)的担忧仍然是一个重大挑战。对人工智能的恐惧还延伸到更广泛的社会影响,如偏见、工作取代、数据隐私、虚假信息的传播以及人工智能对决策过程的影响。

OpenAI公司的迅速崛起是政策制定者在人工智能监管方面迅速采取行动的主要原因之一。OpenAI首席执行官Sam Altman作为美国国会和欧盟委员会的嘉宾,就美国和欧盟新的人工智能监管框架进行谈判。

美国

全球人工智能监管格局正在逐步形成。10 月 30 日,拜登总统发布行政命令,要求人工智能开发人员向联邦政府提供用于训练和测试人工智能的应用程序数据、性能测量及其易受网络攻击的脆弱性的评估。

拜登-哈里斯政府在制定国内人工智能监管方面正在取得进展,包括国家标准与技术研究院(NIST)人工智能风险管理框架以及人工智能公司管理该技术带来的风险的自愿承诺。这被美国政府认可为行业自律做法,受到业界欢迎。

在国会,有几项两党提案。就在上周,著名参议员 Amy Klobuchar 和 John Thune 及其同事提出了两党的《人工智能研究、创新和问责法案》,以促进创新,同时提高高风险人工智能应用的透明度、问责制和安全性。

欧洲联盟

分层方法(如欧盟人工智能法案目前设想的那样)意味着将人工智能分为不同的风险等级,并根据风险水平进行或多或少的监管。

在欧盟,规则草案提出两年半后,最终版本的谈判遇到了重大障碍,法国、德国和意大利公开反对《欧盟人工智能法案》最初设想的分层方法。

欧盟最大的经济体似乎正在放弃严格的人工智能监管概念,而倾向于采取类似于美国模式的自我监管方法。

许多人猜测这种转变是大型科技公司大力游说努力的结果。这三个国家要求欧盟理事会主席国西班牙放弃这一做法,该理事会代表成员国进行三方谈判。法国、德国和意大利希望仅监管人工智能的使用,而不是技术本身,并提出对基础模型“通过行为准则进行强制性自我监管”。

中国

中国是第一个出台生成人工智能暂行措施的国家,自今年8月起生效。

目的是什么?巩固中国在制定全球人工智能监管标准方面的关键角色。中国还在第三届“一带一路”高峰论坛期间推出了

全球人工智能治理倡议,标志着在全球范围内塑造人工智能发展轨迹方面迈出了重大一步。

中国的人工智能治理论坛预计将汇聚155个“一带一路”沿线国家,建立全球最大的人工智能治理论坛之一。这一战略举措重点关注人工智能发展与人类进步相一致、促进互利共赢、反对意识形态分裂等五个方面。它还建立了一个测试和评估系统来评估和减轻人工智能相关风险,类似于欧盟即将出台的人工智能法案的基于风险的方法。

在国际层面

在国际层面,有一些倡议,例如联合国秘书长成立人工智能高级别机构、七国集团(G7)就广岛指导原则达成一致并批准企业人工智能行为准则、布莱切利公园人工智能安全峰会等。

联合国安理会人工智能理事会

联合国安理会举行了首次关于人工智能的辩论(7 月 18 日),深入探讨该技术给全球和平与安全带来的机遇和风险。一些专家也应邀参加了由英国外交大臣詹姆斯·克莱维利主持的辩论。

联合国秘书长安东尼奥·古特雷斯在向 15 名成员组成的理事会通报情况时,提倡采用基于风险的方法来监管人工智能,并支持建立一个新的联合国人工智能实体的呼吁,类似于国际原子能机构、国际原子能机构等模式。民航组织和政府间气候变化专门委员会。

英国人工智能安全峰会

在备受期待的英国峰会上,领先的人工智能国家和公司做出了具有里程碑意义的承诺,即在公开发布之前测试前沿人工智能模型。

《布莱奇利宣言》警示我们当前人工智能所面临的种种风险,包括但不限于偏见、隐私威胁以及欺骗性内容生成。在我们致力于解决这些问题的时候,我们不能忽视前沿人工智能的发展,尤其是那些已经超越现有能力的先进模型,因为它们可能带来无法预见的严重后果。

签署国包括澳大利亚、加拿大、中国、法国、德国、印度、韩国、新加坡、英国和美国,加上欧盟,总共 28 个国家。政府现在将在测试人工智能模型方面发挥更积极的作用。人工智能安全研究所是在英国成立的一个新的全球中心,它将与领先的人工智能机构合作,在新兴人工智能技术公开发布之前和之后评估其安全性。峰会达成了成立人工智能风险国际咨询小组的协议。

联合国人工智能高级别咨询机构

联合国采取了独特的方法,成立了由 39 名成员组成的人工智能高级别咨询机构。在联合国技术特使阿曼迪普·辛格·吉尔 (Amandeep Singh Gill) 的领导下,该机构计划在今年年底前发布第一份建议,最终建议预计将于明年发布。这些建议将在2024 年 9 月举行的联合国未来峰会上进行讨论。

与之前引入新原则的倡议不同,联合国咨询机构的重点是评估全球现有的治理倡议、找出差距并提出解决方案。这位技术特使设想联合国成为各国政府讨论和完善人工智能治理框架的平台。

未来我们对语言模型有何期待?

如果行业继续关注研究和投资,2024 年将带来一些巨大的突破。对于OpenAI来说,Q项目是焦点。Q项目可以解决某些数学问题,据称具有更高的推理能力。这可能是通用人工智能(AGI)领域的潜在突破。

如果语言模型在数学和推理领域发挥其威力,它们将达到更高水平的实用性。包括埃隆·马斯克在内的许多专家都认为,“数字超级智能”将在未来五到十年内出现。

在监管方面,焦点将继续放在确保人工智能使用的安全性上,同时消除未来数据集中的偏见。进一步呼吁人工智能治理方面的全球合作以及提高这些模型的透明度。

中国, 人工智能, 《布莱奇利宣言》