ChatGPT:人机交互的十字路口?智能会计,真的替代路在何方?

文章主题:ChatGPT, 人工智能, 图灵测试, 工作辅助

#中国版chatGPT来了##会计##审计##财务#

🔥ChatGPT热度飙升,全球热议!🚀会计审计领域震动,AI转型已在进行中💪这款人工智能聊天机器人ChatGPT以其强大的语言生成能力,掀起了一场知识革命风暴。各界人士纷纷关注,财务行业也不例外。👀无数文章和视频聚焦于此,探讨其对未来会计、审计工作的潜在颠覆性影响。许多人担忧,AI的崛起是否意味着传统的会计和审计工作将逐渐被淘汰?但这同时也带来了机遇,技术革新要求我们不断适应和学习新技能。🎓会计人员需提升数字化素养,审计行业则可能迎来更高效、精准的审核流程。财会圈热议的背后,是专业人士对变革的深度思考与应对策略的制定。💼企业需要重新评估人力资源配置,确保员工具备与AI共生的能力。同时,教育机构和培训机构也将调整课程内容,以满足新时代的专业需求。尽管ChatGPT引发了广泛关注,但值得注意的是,它并非终结者,而是推动行业进步的强大引擎。让我们共同期待,在这场人工智能浪潮中,会计审计行业的未来将如何书写!🌈

但是也有一句话传播的很远,替代掉你工作的不是AI,而是会充分利用AI的同行。我们肯定是要做那个会充分利用AI替换掉人的那个同行嘛,不然我们在网上看各种新工具的相关信息,只会给自己徒增焦虑,没有什么积极意义。

既然讲到利用AI,那我们就得了解一下这个chatGPT

能力的边界在哪

,能帮我们做什么。就像一把锤子,也得看看这锤子多大,是能锤钉子的还是能锤地的。

ChatGPT是人工智能的一种应用。

讲到人工智能,不得不提到图灵测试。

被称为人工智能之父的图灵,在1950年提出一个问题“机器能否思考?”就是如果人类在与一台机器进行交互时(在当年,交互的方式限于文本),无法辨别对方是人还是计算机,那么,这台机器就可以视为是“智能的”。

然后后来几乎绝大多数人工智能开发的应用都在往“无法辨别对方是人还是计算机”这一条件去开发。

到了2023年,成功推出了chatGPT这个看起来似乎无法根据文本辨别的人工智能。

1、制造人工智能的目的

在具体讲chatGPT的应用之前,我想问问大家,大家想要的人工智能是一个怎样的人工智能。

科幻影视剧中的人工智能通常都是反派,人工智能迟早会毁灭世界的,这种言论传播得非常远。所以毁灭人类是一种想要的人工智能吗?

很明显,有良知的人都不会选这个选项。

🌟当然,我们渴望的人工智能不仅仅是能够流畅交流的聊天机器人,如ChatGPT所示,它更应该具备深度认知和理解能力,能够在交互中模糊界限,实现真正的智能化。但这背后需要技术突破与伦理考量,确保其决策透明且不被滥用。💻虽然目前它的应用广泛,可能涉及一些重复劳动,但未来潜力无限,我们期待它在创新领域发挥更大作用,而非单纯作为套路工具存在。🤔对于ChatGPT这样的技术,我们需要理性看待其优点和局限性,以推动AI向更人性化、智慧化的方向发展。

那我们一起想一想,会不会是那种能帮我工作的人工智能,才是一个好的人工智能呢?

从我的角度出发,如果一个能帮我减轻工作量的人工智能,必然是一个好的人工智能,毕竟谁会对减轻自己工作量的工具烦恼焦虑呢。

那么方便使用,方便工作,降本增效,就是人工智能的一个意义。

那从方便工作这个角度出发,chatGPT能完成什么工作呢?

就目前我们审计小伙伴的使用来看。

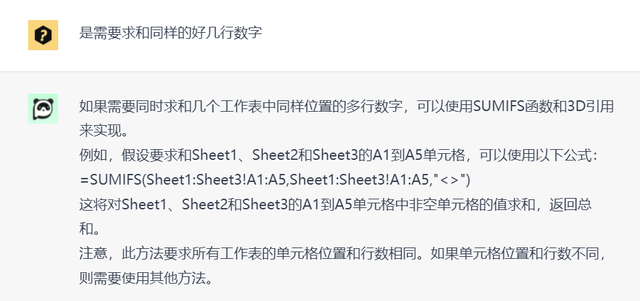

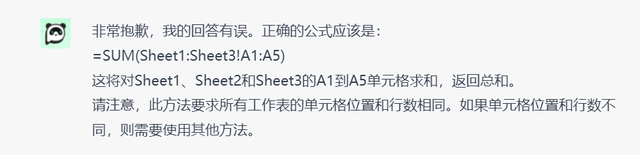

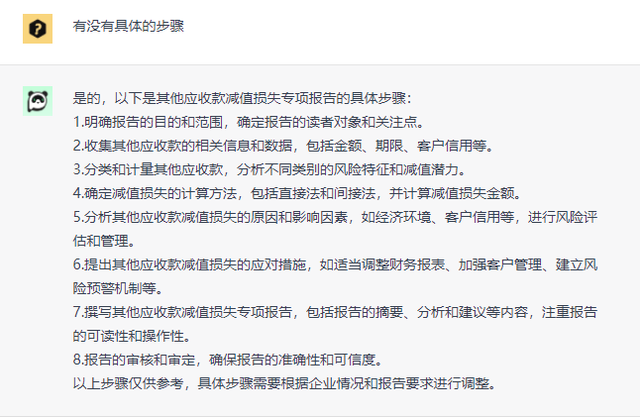

审计小伙伴墨墨:目前第一个年审项目已进入后期,租赁负债需要按照到期时间统计1年以内、1-2年、2-3年和3年以上,这家子公司单体很多,租赁资产有几十个,相应的我们测算了几十张表,那我要统计所有表格信息不可能一张张表来计算,于是我请教了chat.forchange(chatgpt的平替,后面就叫它小c,我输入了问题,给了我一个答案(图1),可能是我没问清楚,第一次回答并不适用,于是我追问了一次,给了我一个公式,实操之后计算有误,于是我问了它第三次,小c真诚和我道歉说之前的公式有问题,重新给了我一个公式,实践证明,这个公式非常好用。一秒钟就计算出了几十张表格的数据。

还可以~~~

当然,会计数字计算和税率查询是财务工作中常见的挑战。虽然无法一一列举所有错误,但这两个方面确实至关重要。例如,在进行税务申报时,精确的税率计算直接关系到合规性和潜在的税收优惠。同样,准确的记账数字能够确保财务报表的完整性和准确性。这些都是每个会计人员必须掌握的基本技能。如果你对这些环节有任何疑问,欢迎随时提问,我会尽我所能提供专业指导。记得,保持精准和细心是关键哦!💪📚

如果让他这样算,然后拿进我们日常工作中,可以想象一下后果哈。

🌟当面对问题时,首要步骤是深入剖析其成因,🤔探究错误背后的机制。别忘了,类似的困扰可能在我们未察觉的角落潜伏,我们需要保持警惕,广泛排查潜在风险。💡每个错误都是一个学习的机会,帮助我们更全面地理解和解决问题。

当我们不断在错误中学习与修正时,确实是在模拟搜索引擎的智能搜索过程。它并非单纯的排除法,而是通过理解上下文,逐步逼近正确答案。让我们换个角度探讨,📚💡 例如,在撰写文章或解决问题时,每一次对错的反思都是对知识的深化和精准定位。这样,我们不仅避免了盲目搜寻,还能提升思考的质量与效率。换句话说,错误并非终点,而是通往真理的必经之路。🚀

2、世界矿脉中,两个挖矿人的使用感受

假如世界是一个矿。我们都是采矿人,都在探索世界的边界,和发掘对人类有用的矿产。

假设A矿工有采矿后休息生活需求,B矿工有采矿工作的需求。

🌟在快节奏的生活中,便捷的信息检索至关重要🔍。偶尔的疏忽不妨宽容对待,比如ChatGPT中的小瑕疵并不会对我们造成实质威胁🛡️。它就像是邻家小孩不经意间的趣谈,轻松而亲切😊。让我们善待科技,享受其带来的便利,而非过分苛求完美💪。

但是在采矿时,那就完全不同的要求了。

B矿工在采矿过程中要时时注意矿洞的情况,随时注意是否有坍塌的危险。还要注意空气够不够呼吸,会不会不小心去到有有毒气体的地方,中毒。

那这时候,作为工具的人工智能,这时候出现一点计算失误,就会导致人受伤甚至死亡,如果使用的人越多,工作的时候越危险。

从这个角度出发,chatGPT并不是一个合格的工具。只能是一个合格的聊天机器。不过大家都说,随着技术的发展,迟早会解决这个问题的。我们或许可以参考一下现在人工智能前沿的一些理论。

3.chatGPT出现错误的原理

我们可以思考一下,为什么会出现这个问题。

人工智能的成功应用,离不开两个东西,一个是数据,一个是算法。打个比方,一个财务报表,也需要数据和公式。

那么数据不准肯定会影响报表准确性,也就影响决策的思路。

据信,chatGPT的训练数据包括维基百科的大部分或全部内容、从网页链接的页面,以及从互联网上获取的10亿个单词。 (它不能包括斯坦福图书馆中的所有电子书副本,因为图书受版权法保护。注意一下,目前这个版本的只有2021年以前互联网数据。

chatGPT的数据都是在广义互联网,大家互相吹水,或者公开的文档中训练出来的。肯定不能百分百准确。

而那些具有知识产权、行业企业内部运营数据肯定拿不到,那这种数据喂养出来的chatGPT,肯定需要大量的排除错误,相当于,要人工把百度搜索出来所有东西都标注对错。因为人工智能无法分辨对错。就像益虫和害虫,只有对人类有益的才叫益虫,有害的都叫害虫。但是人工智能只会告诉你有虫。

这就需要人去判断。

假如正在做一件很有可能有风险的工作,需要非常精准的情报支持的时候,chatGPT这类应用肯定不能作为决定性参考,只能占比很低的参考,甚至不能参考。

我们来看看专家怎么说这技术的原理。

Bender 是华盛顿大学的计算语言学家。她和同事 Alexander Koller 在2020年发表了一篇论文,旨在说明大型语言模型(LLMs)—— 聊天机器人 ChatGPT 背后的技术 —— 能够做什么以及不能做什么。

情境设定如下:假设 A 和 B 都是英语流利的人,分别被困在两个无人居住的岛屿上。他们很快发现以前的岛屿访客留下了电报,他们可以通过水下电缆相互通信。A 和 B 开始愉快地互相发送消息。同时,一只名叫 O 的超智能深海章鱼,无法访问或观察这两个岛屿,发现了一种连接到水下电缆并倾听 A 和 B 对话的方法。O 最初对英语一无所知,但非常善于统计分析。随着时间的推移,O 学会了预测 B 对 A 的每个话语将会做出怎样的反应,并且预测准确率很高。

这个就是chat GPT的原理,从广义互联网中来的信息源,目的是为了更好的聊天,所以部分错误无伤大雅。

“章鱼”不是 Bender 简历上最著名的假想动物,还有一个“随机鹦鹉”。

“Stochastic”意味着随机的,由随机概率分布决定的。“随机鹦鹉”(由 Bender 的创造词汇)指:用随机概率信息将语言形式的序列随意拼接在一起的实体,但不涉及任何涵义。2021年3月,Bender 与三位合著者发表了论文—— 随机鹦鹉的危险:语言模型是否太大?

因为它的本质就是

“随机的鹦鹉”

。怎么理解这个词呢。我说一个成语大家感受一下,“鹦鹉学舌”。鹦鹉学舌指鹦鹉学人说话,比喻人家怎么说,他也跟着怎么说。这也意味着机器本身并无能力思考。机器只是学会了人们大概率会回答的一个套路。

我们不是鹦鹉,我们不仅仅是基于概率,随机地喷出词语。她说,“这是一个非常常见的策略。人们说,‘人们只是随机的鹦鹉’。”她说,“人们非常想相信这些语言模型实际上是聪明的,他们愿意以自己作为参考点,并贬低自己的价值以匹配语言模型可以做到。”

4.审计需要什么样的人工智能

还记得上面我说人工智能的成功应用,离不开两个东西吗?一个是数据,一个是算法。就是一个财务报表需要的数据和公式。

所以chatGPT技术没有问题,之所以chatGPT会回答出错误的答案,是因为数据就出现问题了,信息源出现问题了,那传递的信息肯定是有问题的。

可以想象一下,要人工把chatGPT在所有网络上拉过来的信息中排除错误的信息,或者让人与它聊天互动的时候来排除错误信息,才能使用,那基本上很难创造出新的智慧,只能更好的搬运总结。甚至搬运的东西也有可能出问题。

如果真正要应用到审计这类专业性很强的工作中,那必须保证人工智能中给它喂的数据是基本准确,信息源头基本准确,才能推导出信任度较高的答案。

就像数学一样,一个数字的错误都可能使整个结果都完全不一样,财务审计也是如此。这是我们的可靠性必须保证的问题。

更何况这个chatGPT,只能回答2021年以前有信息的答案,那2022、2023年的呢,这又违背了我们会计基本假设中的及时性原则。

所以就目前来说,chatGPT仅能作为查资料整理资料所用,更专业的东西还不能做。

所以在目前土地、劳动力、资本、技术这四大基本生产要素之外,现在又出现了第五大要素——

数据。

这不仅关系到人工智能等相关新技术的应用,更是开启了继农业文明、工业文明后的3.0人类文明——数字文明。

而目前国内各类数据交易所成立以及推广,或许就是冲着自己可以训练的中小模型去的,为了更多的应用场景。

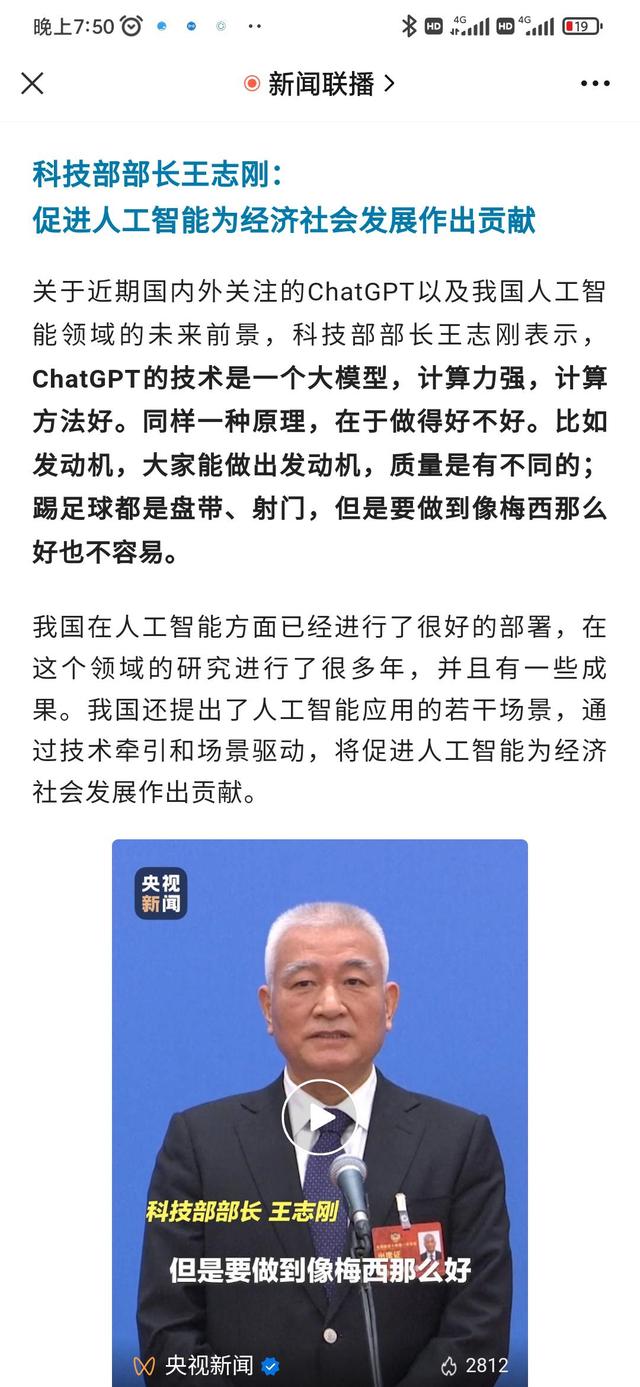

再来回顾chatGPT,用我们科技部部长王志刚的话来总结一下,ChatGPT的技术是一个大模型,计算力强,计算方法好。同样一种原理,在于做得好不好。比如发动机,大家能做出发动机,质量是有不同的;踢足球都是盘带、射门,但是要做到像梅西那么好也不容易。

我国在人工智能方面已经进行了很好的部署,在这个领域的研究进行了很多年,并且有一些成果。我国还提出了人工智能应用的若干场景,通过技术牵引和场景驱动,将促进人工智能为经济社会发展作出贡献。

所以,我也开始期待我们国产人工智能应用了,待我们国产人工智能应用也出现一个爆款,我们也可以再来我们的人工智能~

今天发布的文心一言,很冷静、理智、克制,这就是B端服务长期以来的风格,对更多鼓动人心的话没那么崇尚,更多的都是默默的赚钱~~

这次分享其中很多观点都是正在探讨中的观点,期待更多财会审计圈的小伙伴跟我一起聊聊这已经到来的数字未来~

AI时代,掌握AI大模型第一手资讯!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

扫码右边公众号,驾驭AI生产力!